Нейросети для генерации видео: 6 простых сервисов с бесплатными опциями

Нейросети научились генерировать настолько реалистичные видео, что их сложно отличить от настоящих.

Однако открытые модели пока что не могут создать ролик длиннее нескольких секунд и не слишком точно следуют запросу. Поэтому чтобы добиться хорошего результата, придется сделать множество попыток. Расскажу про нейросети, которые позволяют бесплатно сгенерировать видео.

Оплатить получится не везде

С 2022 года многие иностранные сервисы не принимают оплату российскими банковскими картами. В таких случаях понадобится международная карта. Если сайт принимает оплату в рублях или карточками UnionPay, мы отмечаем это отдельно.

Как писать запросы для нейросетей

В любом сервисе нужно написать промпт — текстовый запрос, то есть описать результат, который вы хотите получить. Почти все нейросети предлагают загрузить референс — картинку, на основе которой будет генерироваться видео. Как правило, с референсными изображениями проще добиться хорошего результата, потому что нейросети есть на что опереться. Иначе ей придется генерировать и картинку, и анимацию с нуля.

Промпты обычно пишут на английском языке. Стандартная схема запроса выглядит так: стиль — объект — действие — окружение — камера — освещение.

Необязательно указывать все параметры. Главное, описать объект и действие. Остальное — опционально. Если генерируете по картинке, то нужно рассказать в запросе, что на этой картинке происходит. Вот какие слова можно использовать:

- стиль: cinematic action (сцена из фильма), animation (анимация), black and white film (черно-белая пленка);

- объект: woman with red hair (рыжая женщина), siamese kitten (сиамский котенок), lonely house (одинокий дом);

- действие: walking (идет), smiling (улыбается), rolling (катится);

- окружение: rooftop (крыша), medieval castle (средневековый замок), cityscape (городской пейзаж);

- положение камеры или тип объектива: wide angle (широкий угол), close up (крупный план), long shot (общий план);

- освещение: sunset (закат), warm lighting (теплый свет), moonlight (лунный свет), studio lighting (студийный свет).

Для честного эксперимента я протестировала все нейросети на одинаковых промптах. Запросы были такими:

- человек читает газету в кофейне — the person is reading the newspaper in a coffeeshop (генерация только по текстовому запросу);

- кошка прыгает на голубой пластиковый стул, парящий в воздухе над облаками — cat jumping on blue plastic chair floating in air above clouds (генерация по текстовому запросу и картинке);

- кот сидит на советском шкафу и уходит, желтое освещение — a cat sits on a soviet cabinet, walking away, yellow lighting (генерация по текстовому запросу и картинке).

Что умеет: генерирует по текстовому запросу и картинке

Насколько хорошо генерирует: ⭐⭐⭐

Сколько бесплатных попыток: 65 секунд видео

Сколько стоит подписка: от 15 $ (1560 ₽)

в месяц

Runway — нейросеть, которая известна благодаря тому, что создает кинематографичные ролики. Еще она умеет делать плавные переходы между кадрами, поэтому ее часто используют для нейросетевых короткометражек или клипов.

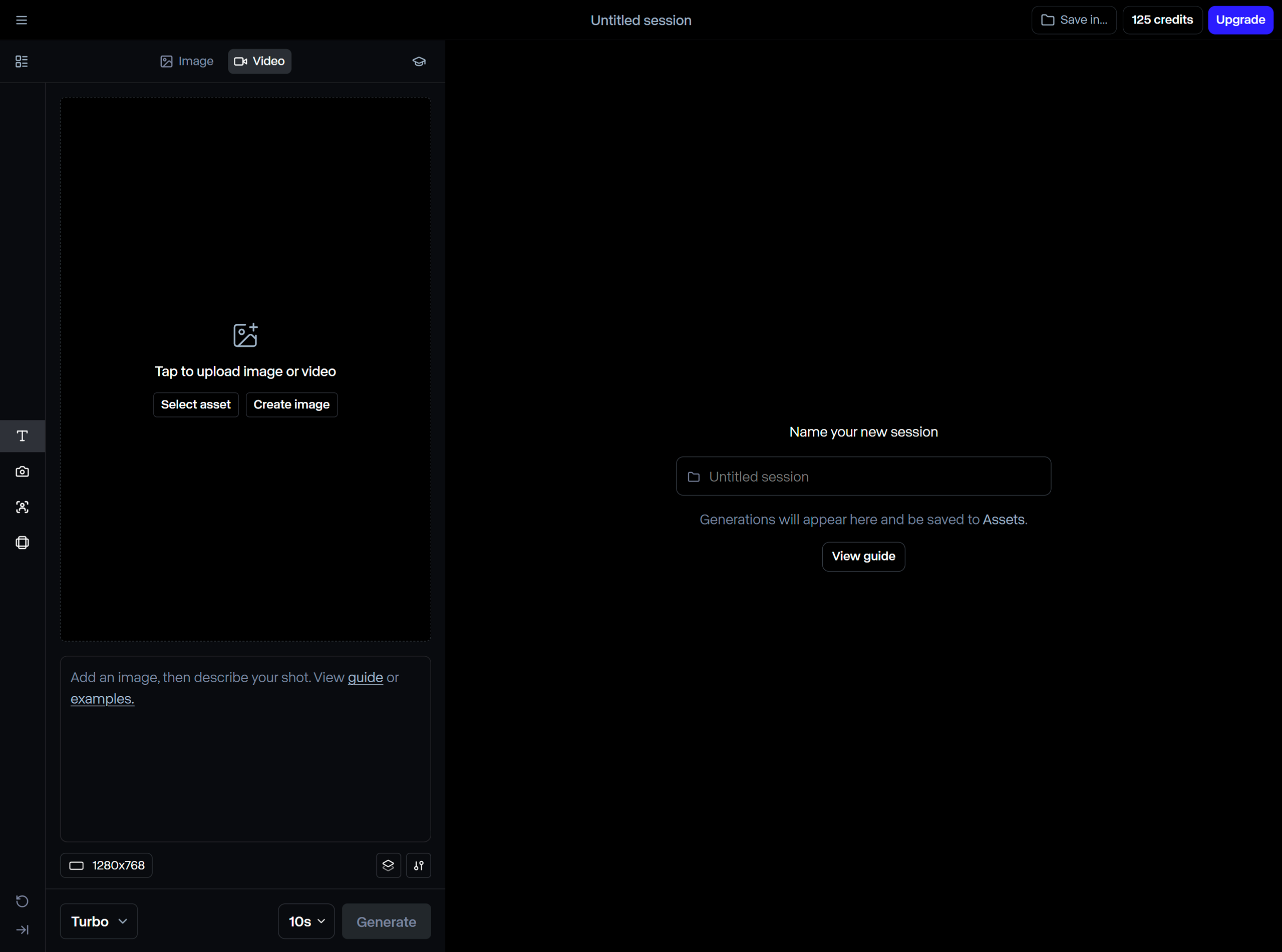

Как пользоваться. Зарегистрируйтесь. На главной странице нажмите Start a new session. Откроется редактор, в котором проходит вся работа. Доступно четыре режима:

- Генерация по текстовому запросу и картинке или видео.

- Генерация с контролем камеры. Позволяет управлять положением камеры в процессе генерации, что дает больше свободы при создании сцены.

- Захват видео для последующей генерации. Можно записать ролик со своим лицом, чтобы на его основе сервис создал эмоции и движения персонажа.

- Продолжение ролика. Функция продлевает уже существующее видео.

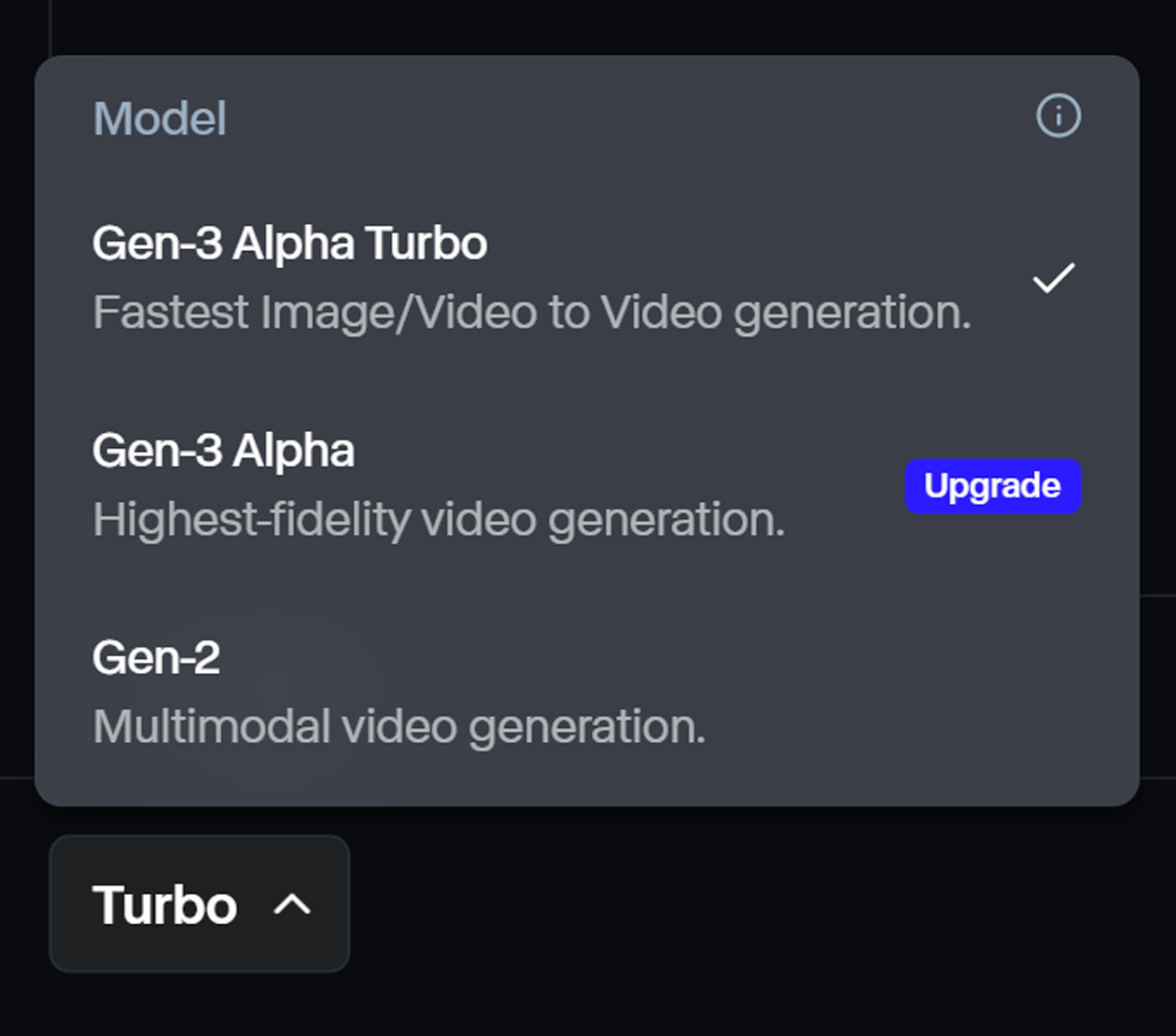

Для начальных попыток выберите первый вариант и введите в поле запрос на английском языке. В настройках можно выбрать разрешение сторон, продолжительность видео — 5 или 10 секунд, а также версию нейросети — Gen-2, Gen-3 Alpha или Gen-3 Alpha Turbo.

Gen-3 Alpha Turbo — быстрая версия актуальной модели, Gen-2 — устаревшая, Gen-3 Alpha доступна только по платной подписке. В режиме Turbo нельзя генерировать только по текстовому запросу: придется также загружать картинку.

Нейросеть откажется от генерации, если на вашей картинке есть объекты интеллектуальной собственности, защищенные авторским правом, или просто знаменитости. Например, изображение с Николасом Кейджем или Шреком она не обработает.

Генерация видео расходует кредиты — по пять за каждую секунду. За регистрацию нового аккаунта Runway дает 325 кредитов. Их хватит на 65 секунд видео, созданного моделью Gen-3 Alpha Turbo. Кредиты не сгорают со временем, но и восполняться тоже не будут. Чтобы получить еще, придется регистрировать новый аккаунт.

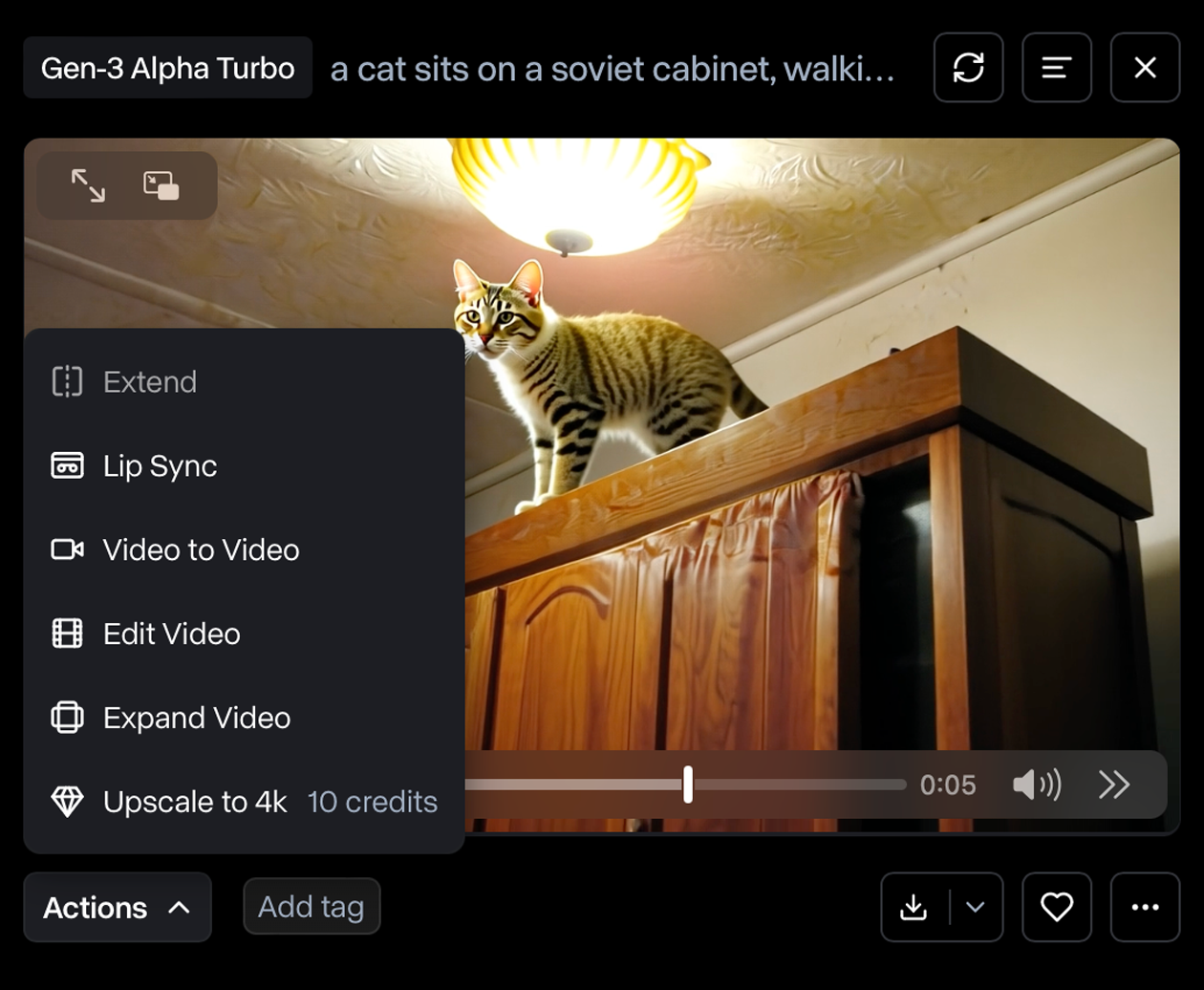

Готовое видео можно продолжить, сгенерировать по нему новый ролик, отредактировать или увеличить качество до разрешения 4K. Все это стоит дополнительных кредитов.

Что получается. Бесплатно генерировать только по текстовому запросу нельзя, поэтому можно оценить только результаты по картинке. На одно видео приходится тратить по несколько попыток, так как Runway не всегда точно следует запросу, даже если он короткий.

К примеру, в моих запросах один кот раздвоился и стал монстром, а другой никак не хотел уходить со шкафа. Перегенерация помогла, благо бесплатных попыток достаточно, чтобы прогнать один запрос несколько раз.

Но сохранилась другая проблема: при анимировании персонаж изменяется и становится более «нейросетевым», чем на оригинальной картинке. Динамика у Runway тоже не идеальная: коты двигаются слишком медленно.

👍 Плюсы:

- Достаточно бесплатных попыток.

- Плавные переходы.

👎 Минусы:

- Нечетко следует запросу.

- Генерация только по текстовому запросу платная.

- Отказывается генерировать известных персонажей.

Что умеет: генерирует по текстовому запросу или текстовому запросу и картинке; добавляет готовые эффекты на видео

Насколько хорошо генерирует: ⭐⭐⭐⭐

Сколько бесплатных попыток: два видео в сутки, но не более 16 в месяц на один аккаунт

Сколько стоит подписка: от 8 $ (850 ₽) в месяц

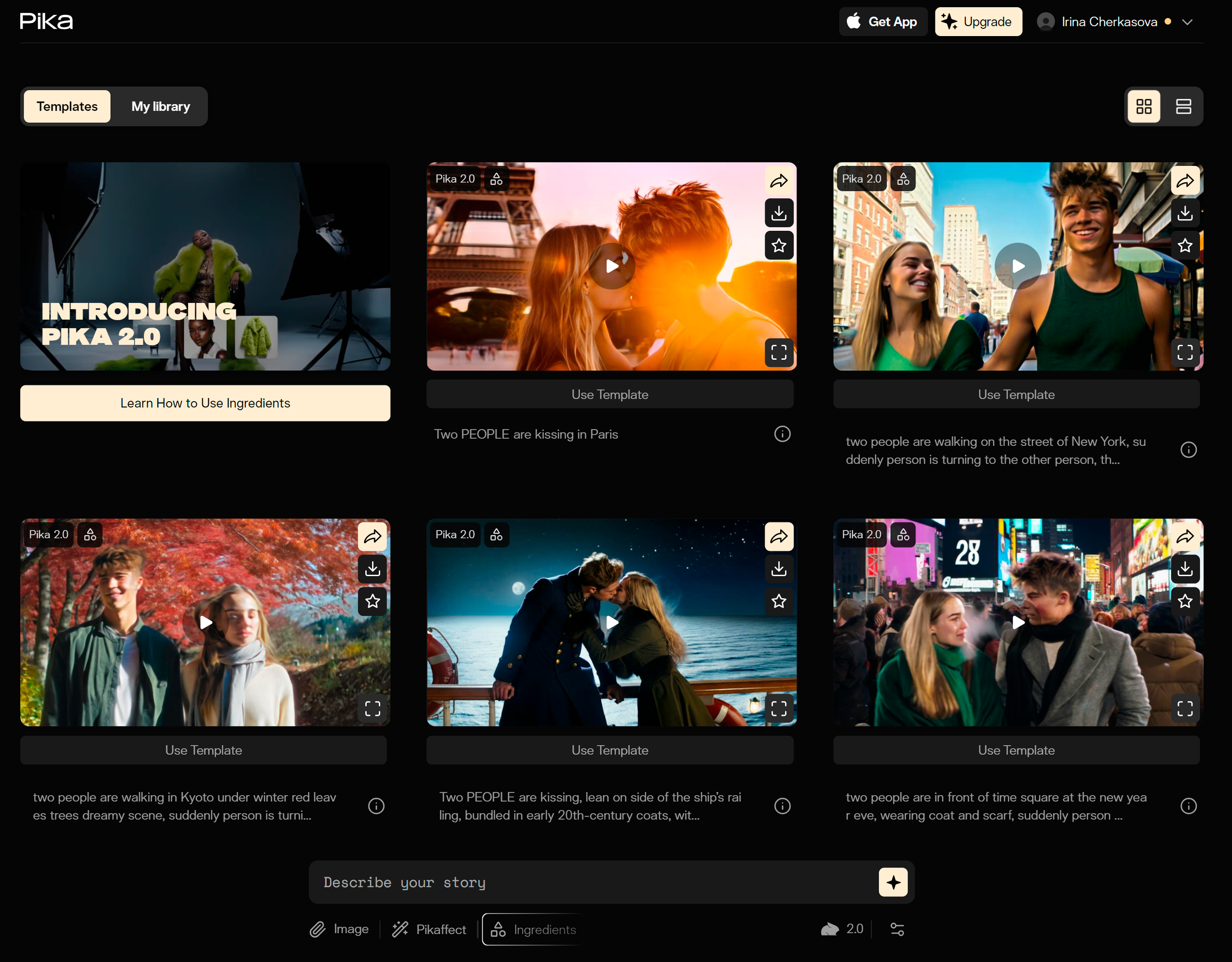

Pika — нейросеть для генерации видео, которая делает упор на визуальные эффекты. Она завирусилась в соцсетях благодаря ИИ-фильтрам, которые трансформируют изображения. Например, сдувают объекты как воздушный шар или разрезают их как торт.

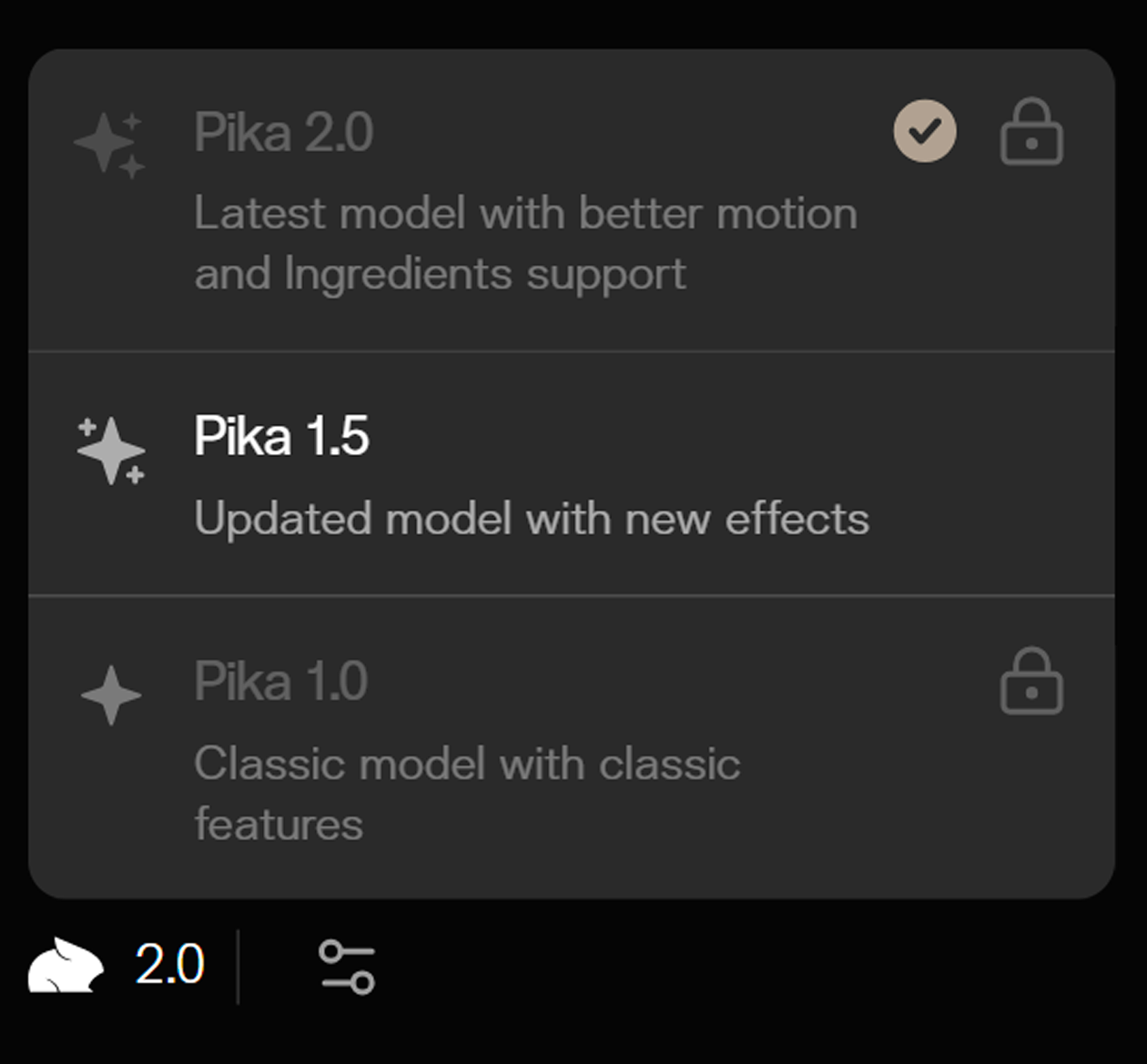

Как пользоваться. После регистрации вы попадете на главную страницу с чужими генерациями и полем для ввода запроса. Есть несколько режимов:

- генерация по текстовому запросу;

- генерация по картинке и текстовому запросу;

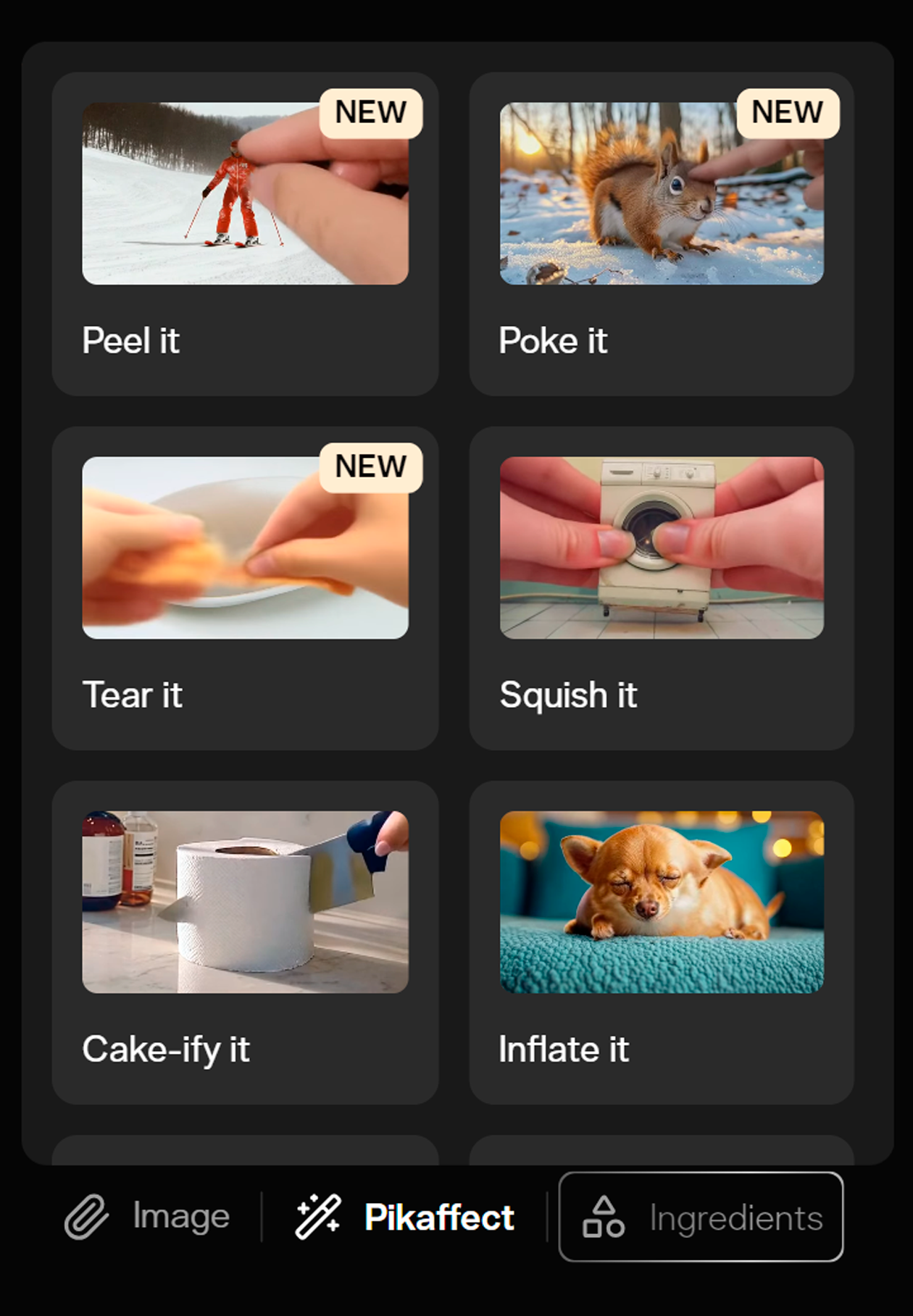

- Pikaffect — визуальные эффекты для анимации изображений по шаблону. К готовым роликам также добавляется звук. Всего 16 эффектов: сплющить, порвать, растворить, надуть, взорвать, раздавить, расплавить и так далее;

- Ingredients — возможность загрузить несколько картинок, из одной взять визуальный стиль, из другой — персонажа, а потом на основе этого сгенерировать видео.

Проще всего использовать Pikaffect. Достаточно загрузить картинку, выбрать понравившийся фильтр, нажать кнопку генерации, дождаться обработки и сохранить видео. Никаких настроек тут нет. А если не понравился результат, то ролик можно перегенерировать, нажав на Retry.

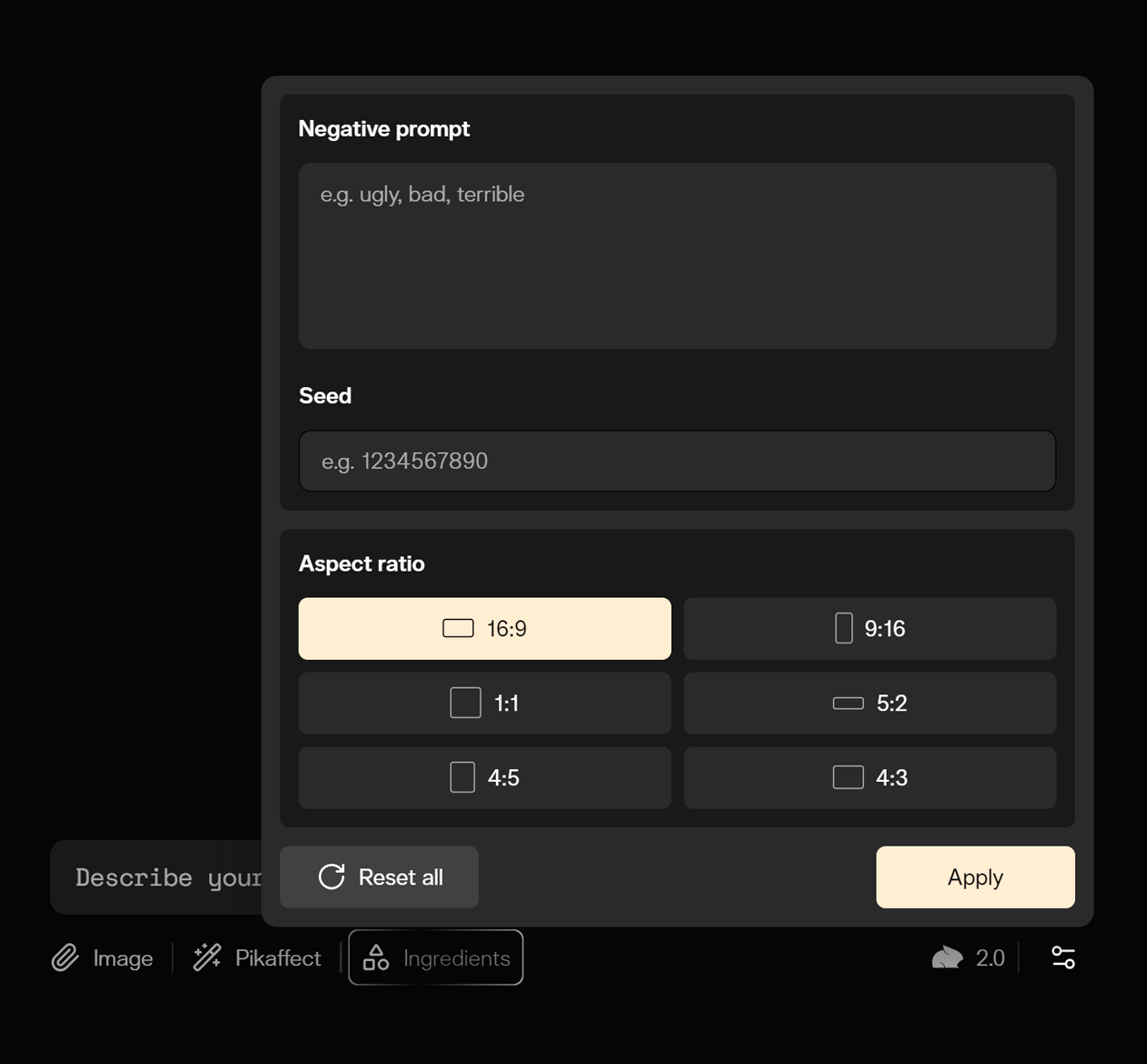

Чтобы создать видео с нуля, в поле для запроса напишите промпт на английском языке, при желании загрузите картинку. В настройках можете указать:

- все, чего не должно быть на видео, — такой запрос называют отрицательным;

- соотношение сторон — доступно только для генерации по текстовому запросу. Если загрузить картинку, то разрешение сторон выставляется автоматически;

- Seed — цифровое обозначение конкретной генерации. В это поле можно ввести значение сида предыдущего ролика, чтобы повторить визуальный стиль.

При генерации по тексту или картинке без эффектов Pika обрабатывает запрос намного дольше — будьте к этому готовы.

Одна генерация стоит 15 кредитов. Каждый пользователь бесплатно получает при регистрации 250 кредитов — они восполняются каждый месяц. То есть ежемесячно можно сгенерировать 16 бесплатных видео. При этом в день Pika разрешает генерировать только 2 видео.

Если такого количества видео не хватает, придется покупать подписку. Еще вариант: зарегистрировать новый профиль. Правда, в бесплатной версии сервис добавляет огромный водяной знак на весь ролик.

Что получается. Pika отлично справляется с генерацией только по текстовому запросу: цвета насыщенные, композиции красивые. Артефактов не слишком много, но все же они есть.

С генерацией по картинке вышло не очень: кот превратился в слишком контрастного и непохожего на себя, двигался неестественно. Видно, что динамика дается нейросети хуже, чем сцены с небольшой анимацией.

Заготовленные сервисом эффекты работают отлично, но только если выбирать картинку с персонажем, который занимает большую часть изображения. Маленькие объекты он просто не распознает и прикрепляет эффект к пустому пространству.

👍 Плюсы:

- Проста в использовании.

- Есть готовые эффекты.

👎 Минусы:

- Жесткие лимиты.

- Долго генерирует, если не выбирать эффекты.

Что умеет: генерирует по текстовому запросу, по персонажу или по картинке и текстовому запросу

Насколько хорошо генерирует: ⭐⭐⭐⭐⭐

Сколько бесплатных попыток: примерно 30 видео

Сколько стоит подписка: от 10 $ (1116 ₽) в месяц

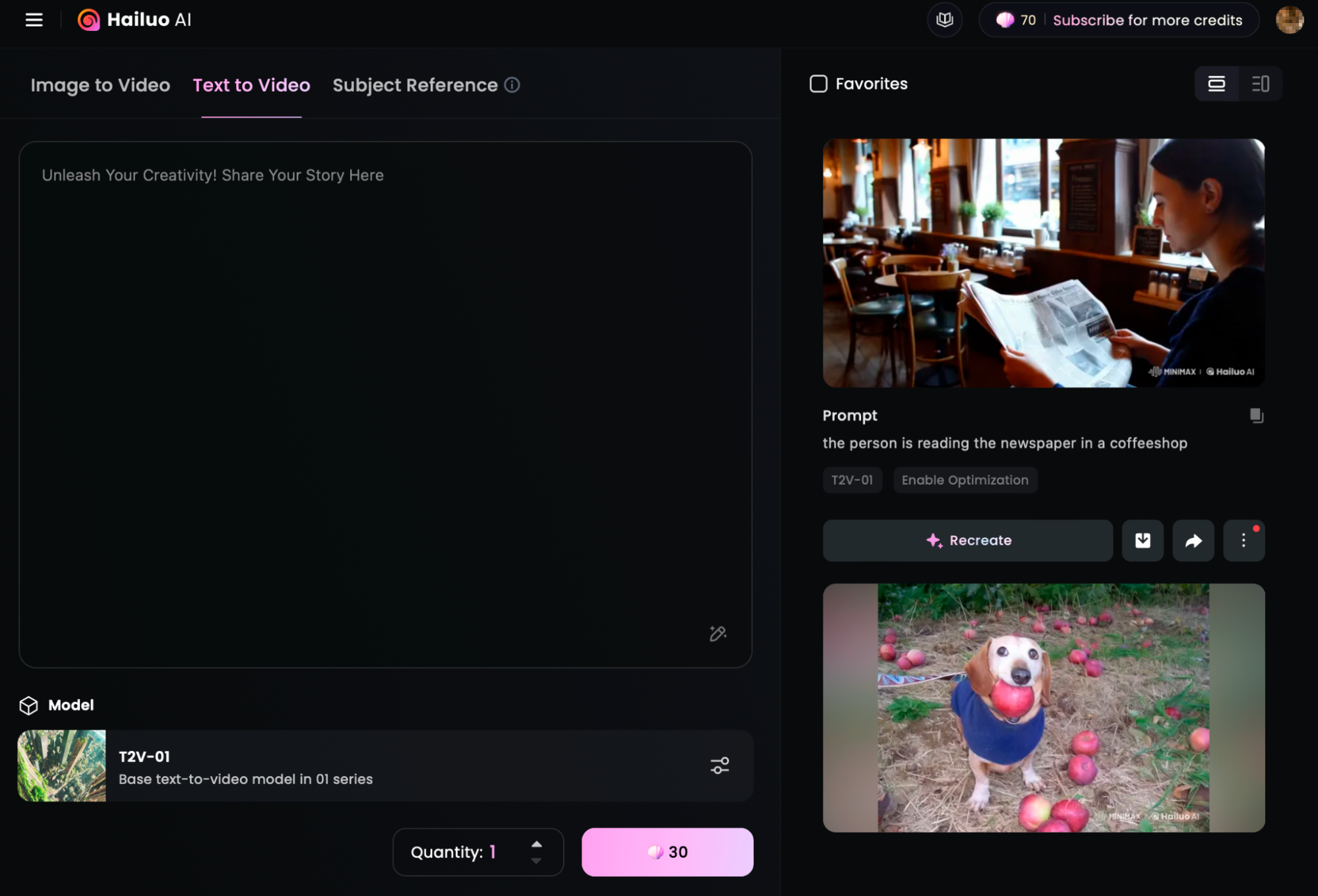

Hailuo — китайская нейросеть, которую используют для оживления картинок и создания мемов. Например, в конце 2024 года именно в ней делали ролики про собаку с яблоком во рту. А еще она создает реалистичные видео, которые часто принимают за настоящие в соцсетях.

Как пользоваться. После регистрации на главной странице нажмите на раздел Create. Вы попадете в редактор, где доступно три режима:

- Text to Video генерирует ролик на основе текстового запроса.

- Image to Video генерирует ролик на основе картинки и текстового запроса.

- Subject Reference генерирует ролик с конкретным персонажем на основе его изображения или фотографии.

Выберите понравившийся режим, введите текст или другой контент. Никаких сложных настроек нет — только выбор модели, количество генераций за один раз и кнопка Enhance Prompt. Она переписывает и улучшает промпт, чтобы он стал более понятным для нейросети. Рекомендую не отключать ее.

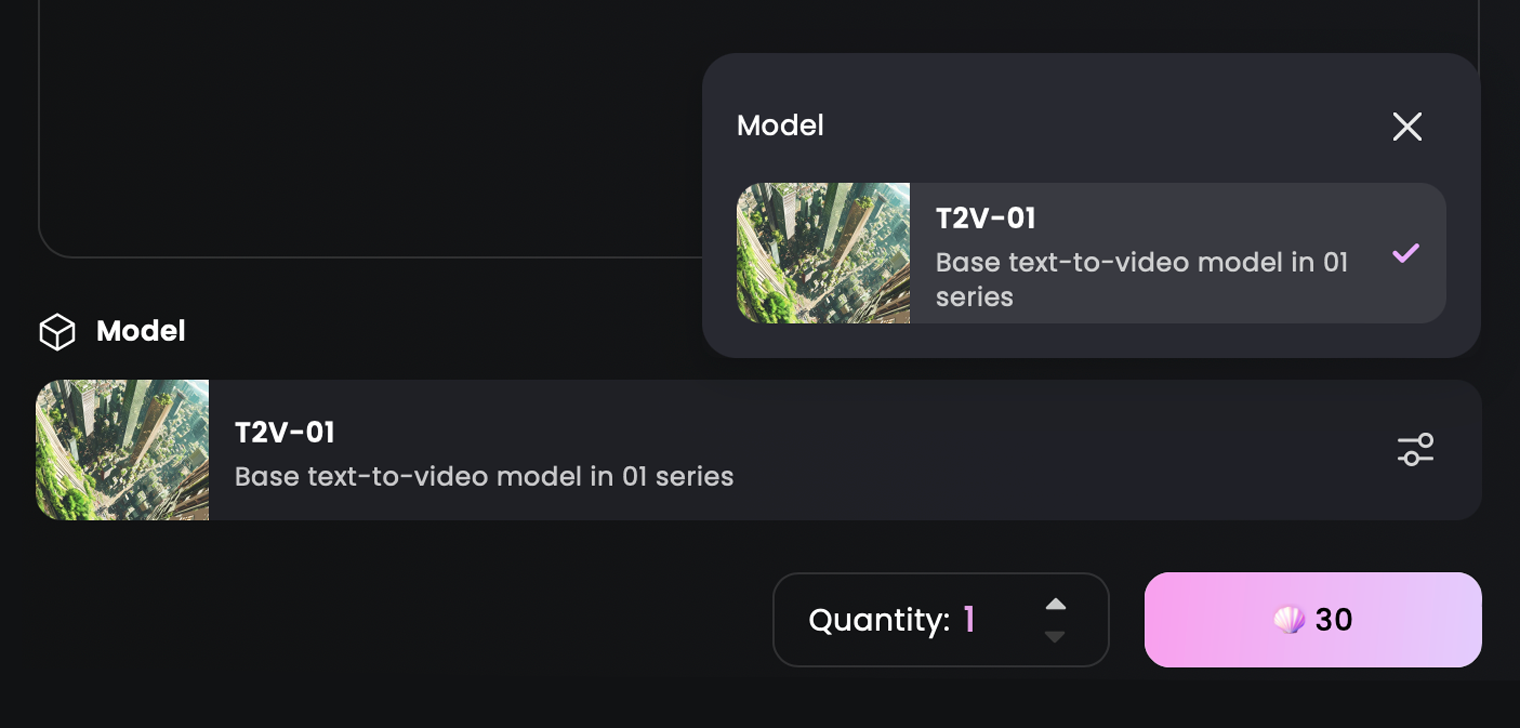

Моделей всего две: базовая I2V-01 и новая I2V-01-live. Вторая хорошо справляется с аниме, подходит для анимации и оживления 2D-картинок. Если нужен реализм, то выбирайте базовую. Когда закончите, нажмите кнопку с ракушкой — она запустит генерацию.

Одна генерация тратит 30 кредитов. После регистрации вам начислят 1000 кредитов, которые нужно потратить за три дня. Еще 100 кредитов добавляется каждый день. Они не переносятся на следующий день: сгорают, если их не потратить. Получается, что в первые три дня можно создать 33 ролика, а потом генерировать по три в день. Это самое щедрое предложение среди всех сервисов для генерации видео.

Результаты генераций появляются справа от редактора. Их можно сохранить, поделиться ссылкой на них или переделать с помощью кнопки Reсreate. Перегенерация потратит еще 30 кредитов. Отредактировать ролик нельзя.

Результаты. Видео выглядят динамично. Герои двигаются активно, в роликах нет эффекта замедленной съемки, как у многих других сервисов. Большой плюс — очень много бесплатных попыток, поэтому один и тот же запрос можно прогнать хоть десять раз. Один из этих результатов точно будет неплохим.

Если генерировать только по текстовому запросу, то результаты получаются довольно непредсказуемыми. Поэтому рекомендую генерировать по картинке — Hailuo отлично с этим справляется. Видео реалистичные, а персонажи не морфятся, то есть не трансформируются в кардинально других героев.

👍 Плюсы:

- Много бесплатных попыток.

- Динамичные и реалистичные ролики.

- Проста в использовании.

👎 Минусы:

- Практически нет настроек.

Что умеет: генерирует по текстовому запросу или по картинке и текстовому запросу; создает липсинк-видео

Насколько хорошо генерирует: ⭐⭐⭐⭐⭐

Сколько бесплатных попыток: примерно 10 видео в месяц

Сколько стоит подписка: 10 $ (1117 ₽)

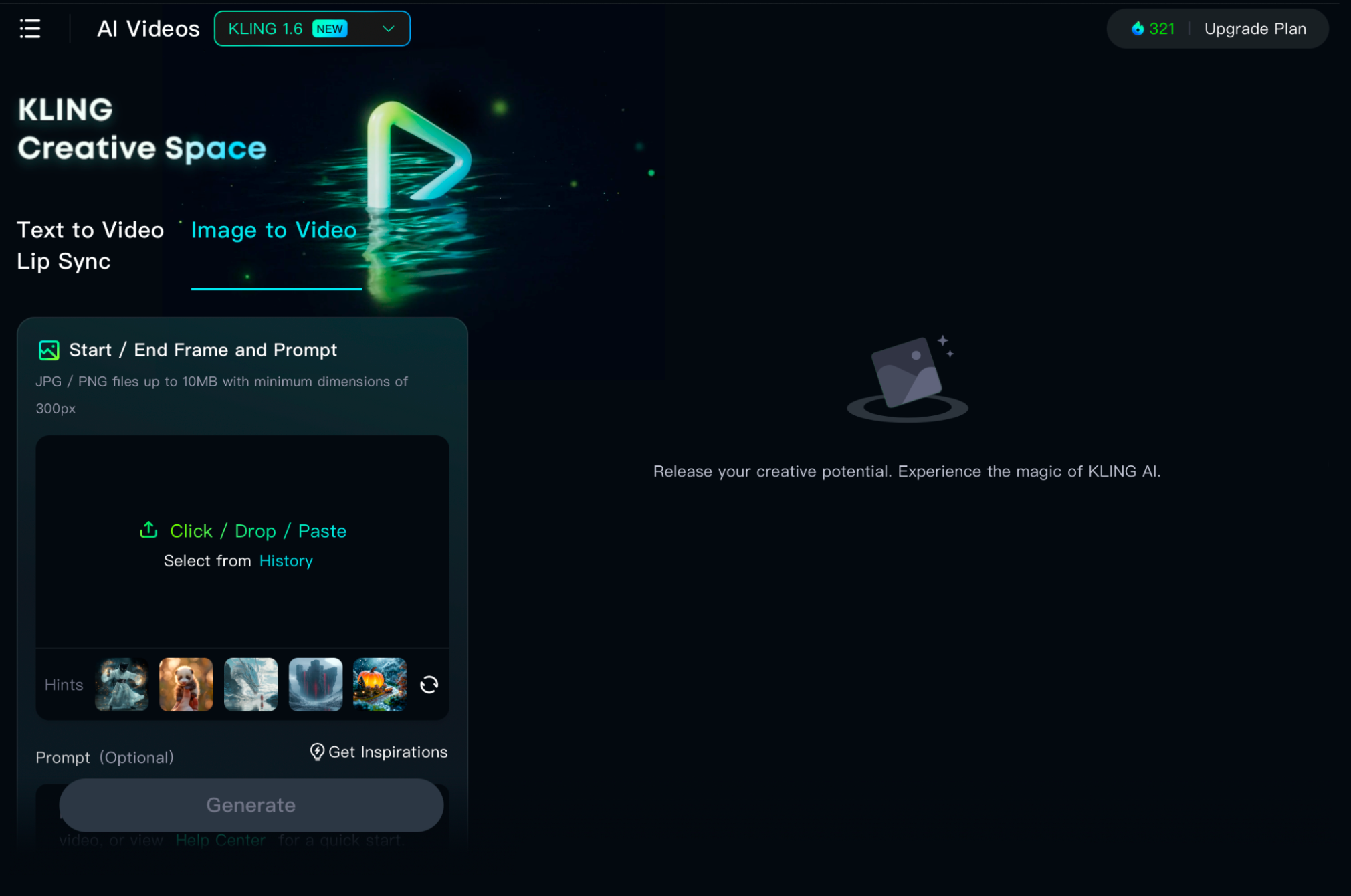

Kling — китайский сервис для генерации видео, который стал популярен благодаря высокому качеству и реалистичным роликам. Изначально был доступен только для пользователей из Китая, но теперь открыт для всех.

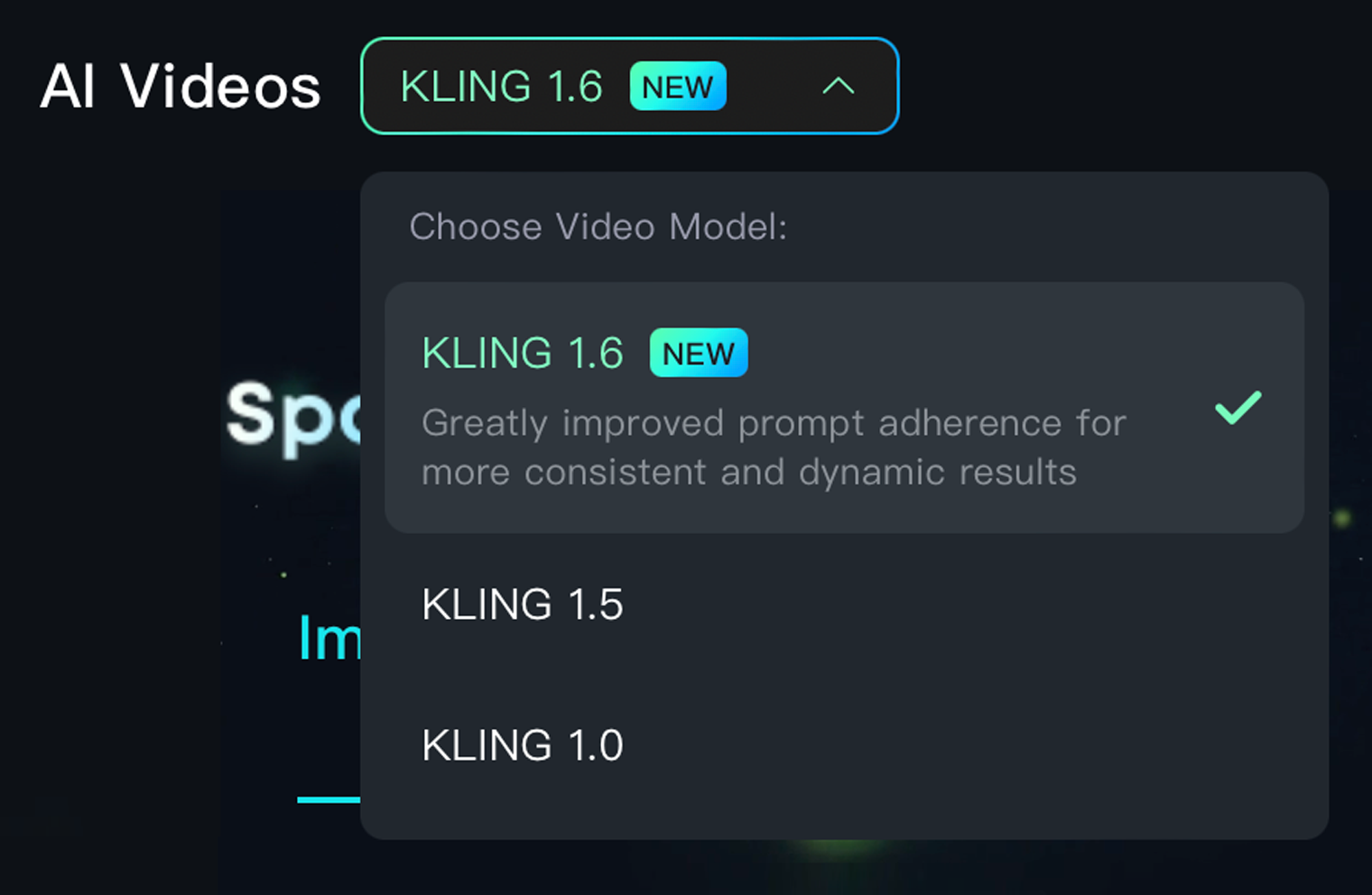

Как пользоваться. Зарегистрируйтесь и нажмите на AI Videos. После этого откроется Kling Creative Space — основное пространство для создания видео. Здесь доступно три режима:

- Text to Video — генерация по текстовому запросу.

- Image to Video — генерация по текстовому запросу и картинке.

- Lip Sync — генерация липсинка по видео. Позволяет загрузить видео с персонажем, а также закадровый голос или песню. ИИ синхронизирует движения губ персонажа со звуком. Работает только с людьми, животных не поддерживает.

На выбор доступны три модели: Kling 1.6, Kling 1.5 и Kling 1.0. Чем больше значение, тем версия актуальнее и тем дороже генерации. Модель Kling 1.6 часто недоступна для бесплатных пользователей из-за «высокой нагрузки на сервере». У меня так и не получилось с ее помощью ничего сделать: сервис постоянно предлагал купить подписку.

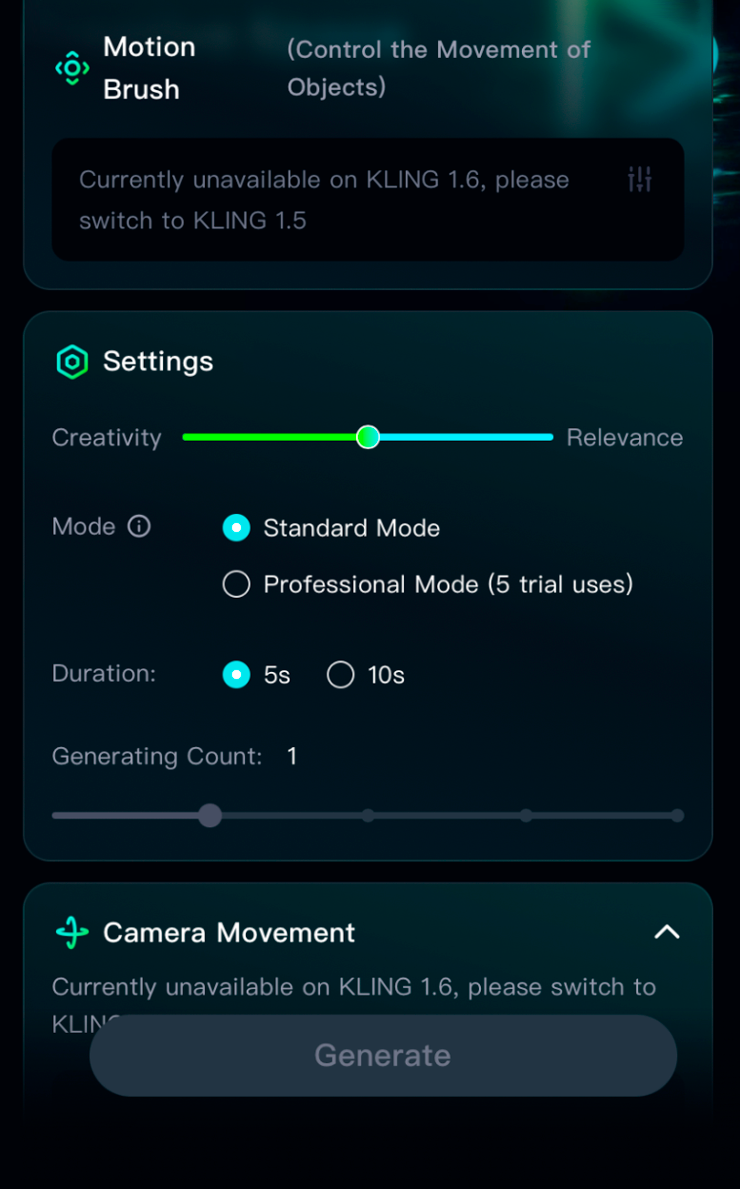

Если выбрали генерацию по тексту или картинке, то напишите запрос и опционально загрузите изображение. После поля с промптом есть дополнительные настройки, которые влияют на результат:

- Creativity отвечает за точность следования запросу. Ползунок можно перемещать от Creativity до Relevance. Условно, от «сделать красиво» до «максимально точно следовать инструкции»;

- Mode — режимы генерации: Standard быстрее, Professional дает картинку более высокого качества. Бесплатно доступно только пять тестовых попыток в Professional Mode;

- Length — выбор продолжительности видео: 5 или 10 секунд;

- Aspect Ratio — соотношение сторон. Настройка доступна для генерации только по текстовому запросу;

- Generating Count — количество генераций. Больше одной можно установить только с подпиской;

- Camera Movement — контроль движения камеры. Настройка доступна только по платной подписке;

- Negative Prompt — отрицательный запрос, то есть описание того, чего не должно быть в видео. Сервис не всегда точно следует указаниям из него — может проигнорировать часть требований.

Можно оставить настройки по умолчанию и ничего не трогать. Креативность будет выставлена на 0,5, продолжительность видео — 5 секунд, кадр горизонтальный, разрешение сторон 16:9. Когда закончите, нажмите Generate и дождитесь результата.

Одна генерация стоит 35 кредитов. За регистрацию сервис начисляет 366 кредитов. Они восполняются каждый месяц. Всего получится сгенерировать 10 видео, дальше — регистрировать новый аккаунт или покупать подписку.

По сравнению с другими сервисами Kling генерирует очень долго — на некоторые запросы уходит три часа. Может получиться так, что вы ждали несколько часов, а запрос закончился ошибкой. Быстро генерируются только липсинк-видео.

Результаты. Kling отлично справляется с генерацией реалистичных видео. В роликах практически не видно артефактов. Персонажи не превращаются в других героев прямо посреди видео — проблема морфинга, с которой сталкиваются многие другие сервисы, практически отсутствует.

Сильная сторона Kling — динамика. Движения получаются плавными и энергичными, нет эффекта «застывшей картинки» или странных пауз между кадрами. Даже при сложных движениях — например, коту нужно прыгнуть на висящий в воздухе стул — качество остается стабильным. Единственный минус — на бесплатном плане результатов приходится ждать очень долго.

👍 Плюсы:

- Реалистичные и качественные ролики без артефактов.

- Много бесплатных генераций.

👎 Минусы:

- Большая часть настроек доступна только по подписке.

- Очень долгая генерация.

- Актуальная версия доступна только по подписке.

Что умеет: генерирует по текстовому запросу

Насколько хорошо генерирует: ⭐⭐⭐

Сколько бесплатных попыток: 2 видео каждые 6 часов, но не более 30 в месяц

Сколько стоит подписка: 10 $ (1040 ₽) в месяц

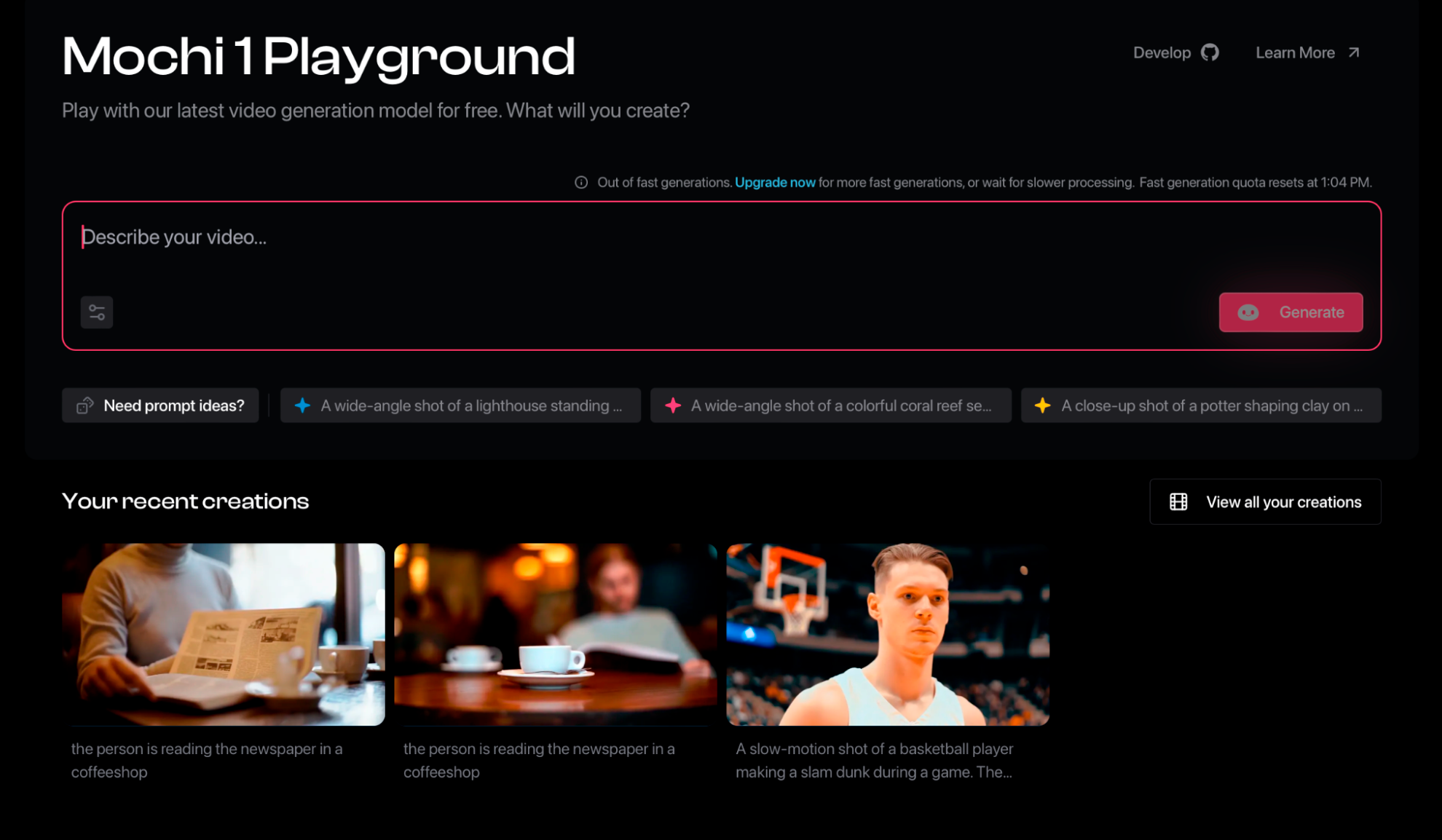

Сервис Genmo предоставляет доступ к модели Mochi-1 с открытым исходным кодом. Это означает, что ее можно скачать, установить на компьютер и настроить под себя. На сайте Mochi-1 доступна в простом веб-интерфейсе — безо всяких проблем со сложной установкой.

Как пользоваться. На главной странице нажмите Try Now и зарегистрируйтесь. Откроется редактор со строкой для ввода запроса и выпадающим меню с настройками. Снизу появятся результаты ваших генераций и работы других пользователей.

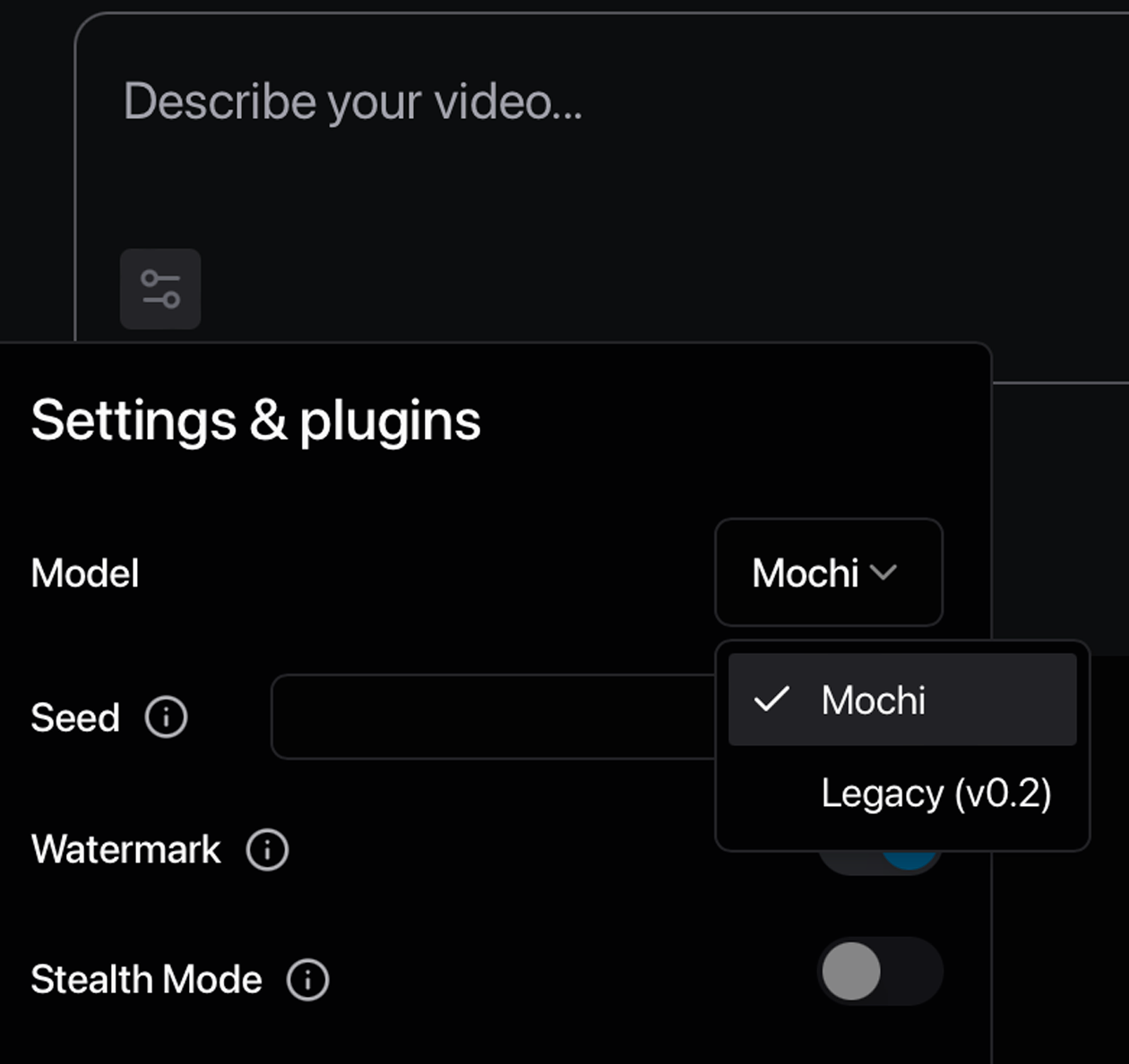

На выбор есть две модели — Mochi 1 и устаревшая Legacy v 0.2. У последней много настроек и доступна генерация по картинке, но качество значительно хуже, чем у актуальной, поэтому не рекомендую ей пользоваться.

У Mochi 1 настроек нет вообще. Можно установить seed, убрать водяной знак и сгенерировать видео приватно, но последние две опции доступны только по подписке.

В поле для ввода запроса напишите промпт. Можно и на русском языке, но нейросеть понимает его хуже, чем английский. Если нет идей, то под строкой есть опция Need prompt ideas. Нажмите на него, и в поле появится случайная идея для генерации. Когда закончите, нажмите на Generate.

Бесплатно можно генерировать по два видео каждые шесть часов и примерно 30 видео в месяц. Результат нельзя редактировать или дорабатывать. Можно только скачивать, попробовать еще раз или изменять промпт.

Результаты. Визуализация людей нейросети дается тяжело: в моем запросе она отказывалась генерировать человека и фокусировалась на газете. При этом даже в таком ролике оказалось много артефактов и замыленного пространства.

Также нейросеть игнорирует части запроса — например, кот не стал спрыгивать со шкафа, а остался там сидеть. Но зато такая анимация без динамики выглядит неплохо. Mochi 1 подходит для относительно статичных сцен — сложные движения даются нейросети с трудом. Большое количество генераций сглаживает этот недостаток.

👍 Плюсы:

- Много бесплатных генераций.

👎 Минусы:

- Плохо генерирует в динамике.

- Игнорирует часть запроса.

- Нет настроек и генерации по картинке.

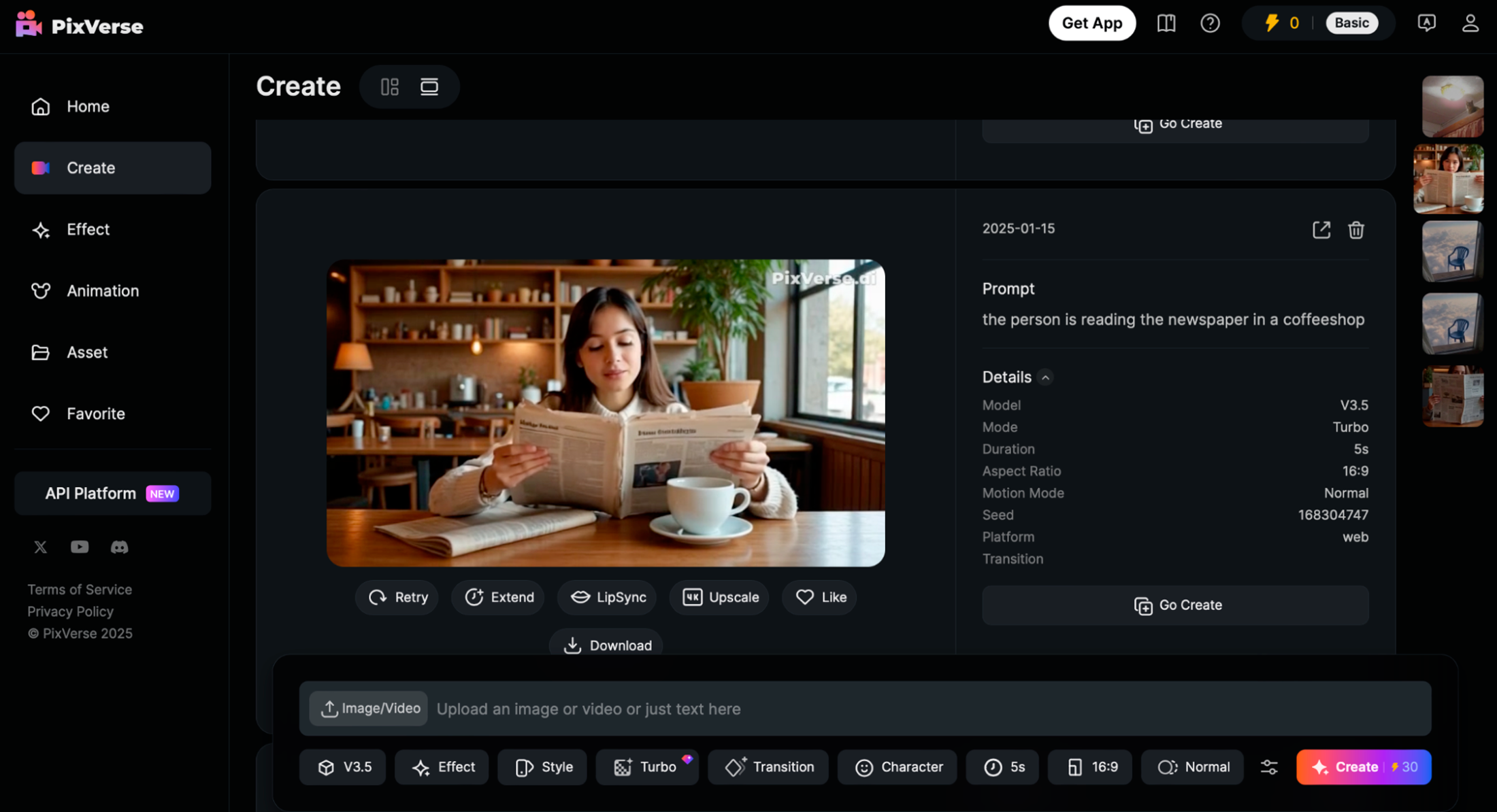

Что умеет: генерирует по текстовому запросу, картинке или видео

Сколько бесплатных попыток: 5 роликов в первый день, потом — по 2 ежедневно

Насколько хорошо генерирует: ⭐⭐⭐

Сколько стоит подписка: от 10 $ (1115 ₽) в месяц

Сервис Pixverse отличается тем, что на генерацию видео уходит около 10 секунд — это самая быстрая нейросеть в подборке. За такую скорость приходится платить качеством.

Как пользоваться. Зарегистрируйтесь и нажмите Create. Появится поле для ввода запроса. Введите запрос на английском языке, при желании загрузите картинку или видео для референса. После этого установите настройки:

- модель — V2.5, V3 и V3.5. Выбирайте последнюю, потому что она самая актуальная и генерирует качественнее всего;

- эффекты — фильтры, которые напишут запрос вместо вас. Останется только вписать объект. Есть фильтры: Халк, Джокер, Санта, «Лего», зомби и другие;

- стиль — аниме, 3D, комиксы, киберпанк, пластилиновые персонажи;

- переход — возможность загрузить следующий референсный кадр для перехода к нему;

- персонаж — возможность загрузить картинку с конкретным героем и сгенерировать ролик с ним;

- время видео — 5 или 8 секунд;

- разрешение сторон — доступно только при генерации по текстовому запросу;

- негативный запрос — то, чего не должно быть в кадре;

- Seed — цифровое обозначение конкретной генерации. Можно ввести значение сида предыдущего ролика, чтобы повторить визуальный стиль.

Когда выставите настройки, нажмите Create. Одна генерация расходует 30 кредитов. После регистрации дают всего 130. После этого каждый день будет начисляться по 60 кредитов. Непотраченные сгорают.

Результат генерации появится через несколько секунд над полем для ввода запроса. Есть возможность перегенерировать ролик, продлить на пять секунд, повысить в качестве или скачать. Также можно заставить персонажа липсинкать. Любые манипуляции с видео оплачиваются кредитами.

Результаты. Ролики получились достаточно реалистичными. Нейросеть старается следовать запросу, хотя и не всегда это получается. Например, с котом получилась забавная, но вполне типичная галлюцинация — животное пытается запрыгнуть на стул, но проваливается сквозь него.

Относительно статичные ролики с небольшой анимацией получаются неплохо — девушка в кофейне выглядит приемлемо. Когда дело доходит до движения и динамики, результат выглядит неестественным. К тому же есть странные дефекты и искажения, которые видно невооруженным глазом.

👍 Плюсы:

- Очень быстрая генерация.

- Нейросеть хорошо следует запросу.

👎 Минусы:

- Плохо справляется с динамикой.

- Заметны артефакты.

Мы постим кружочки, красивые карточки и новости о технологиях и поп-культуре в нашем телеграм-канале. Подписывайтесь, там классно: @t_technocult