Нейросеть «Яндекса» качественно переводит иностранные ютуб-видео: как ей пользоваться

Нейросети «Яндекса» больше года переводят на русский язык и озвучивают видео. Они умеют различать разных спикеров в одном ролике и знают пять языков.

Прототип технологии машинного перевода видео и закадровой озвучки в реальном времени «Яндекс» представил в июле 2021 года. Тогда он работал только с отобранными видео на английском языке. Спустя полтора года эта функция — одна из самых полезных в «Яндекс-браузере». Технология позволяет переводить видео уже с пяти языков: английского, французского, испанского, немецкого и итальянского.

Расскажу, как активировать функцию, как она работает и какие проблемы пришлось преодолеть для создания качественной закадровой озвучки нейросетями.

Что вы узнаете из материала

Зачем нужен закадровый перевод видео

Контента на русском языке значительно меньше, чем на английском. В ноябре 2022 года во всем интернете насчитывалось больше 1,1 млрд сайтов. Из них на русском — меньше 10%. Англоязычных видео намного больше, чем русскоязычных.

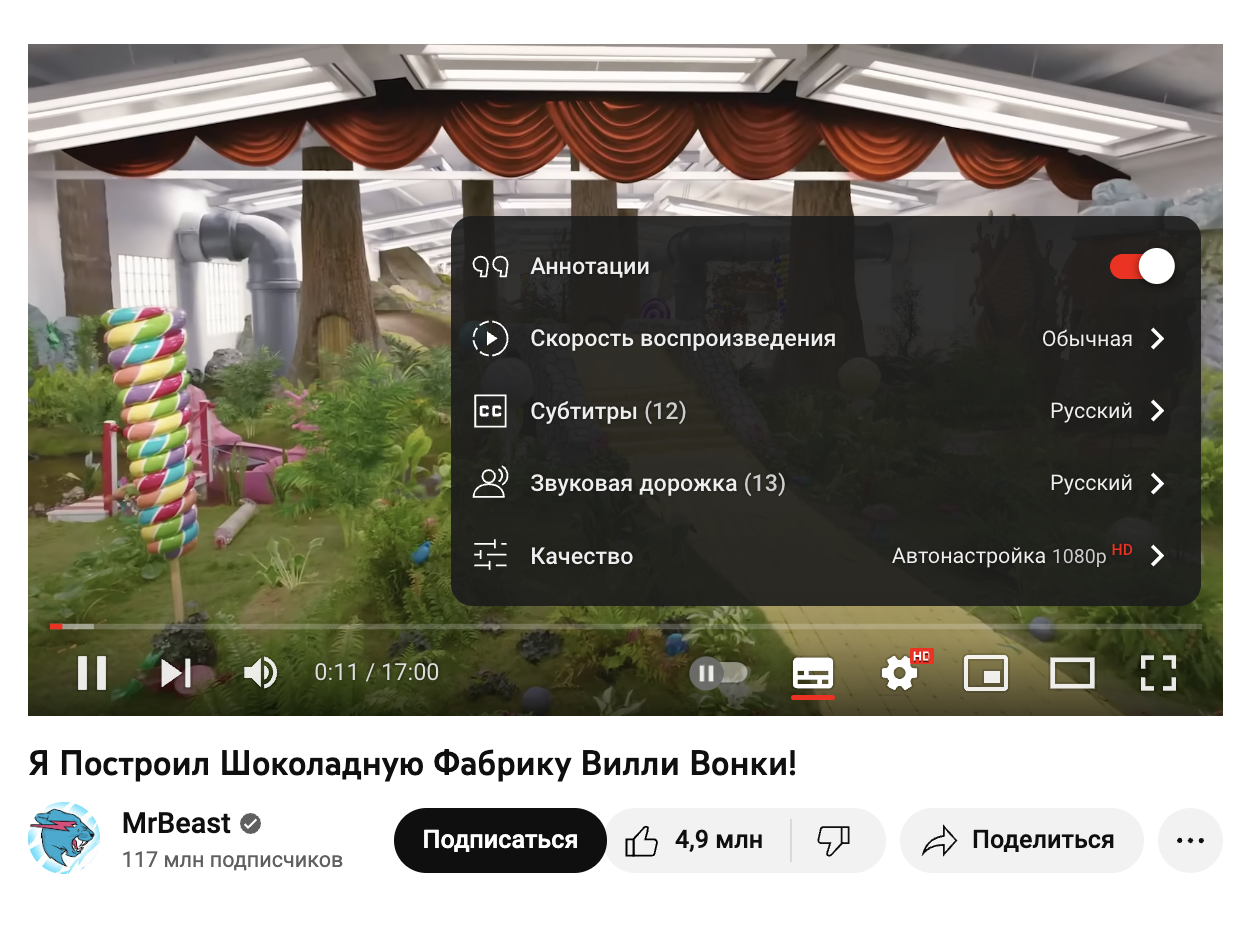

На YouTube можно встретить целые проекты, которые занимаются озвучками иностранных роликов. Но это долго, много видео так не переведешь, к тому же переведенные ролики периодически удаляют за нарушение авторских прав. Англоязычные блогеры и образовательные проекты редко добавляют российскую озвучку — можно вспомнить разве что самого популярного ютубера в мире Mr.Beast. Закадровый перевод от «Яндекс-браузера» решает многие из этих проблем.

Некоторого полезного контента на русском языке нет вообще. Например, видеороликов, помогающих учиться, развиваться, решать рабочие и профессиональные задачи. Фотографы могут выбрать объектив после просмотра видео, а дизайнеры — графический планшет. Большинство обзоров техники сначала появляется как раз на английском языке.

Некоторые темы вообще трудно найти в русскоязычном сегменте YouTube. Я столкнулся с этим, когда искал сравнение двух фотоаппаратов моментальной печати Polaroid.

Также в открытом доступе есть много уникального и полезного контента. Например, курсы или лекции от ведущих мировых университетов. Авторы редко переводят такие видео на русский язык. Обычно их можно смотреть максимум с субтитрами. Некоторые наиболее популярные лекции переводят энтузиасты. Но таких видео мало.

Помогает смотреть видео в фоновом режиме. На том же YouTube неплохо обстоит ситуация с субтитрами: они даже генерируются автоматически, в том числе и русскоязычные. Но так сложнее воспринимать видео на незнакомом языке во время готовки или занятий спортом.

К тому же, согласно исследованию Morning Consult, 86% опрошенных россиян предпочитают смотреть контент на стриминговых платформах в дубляже, а не с субтитрами или полностью в оригинале. Это самый высокий показатель среди 15 стран — участниц опроса.

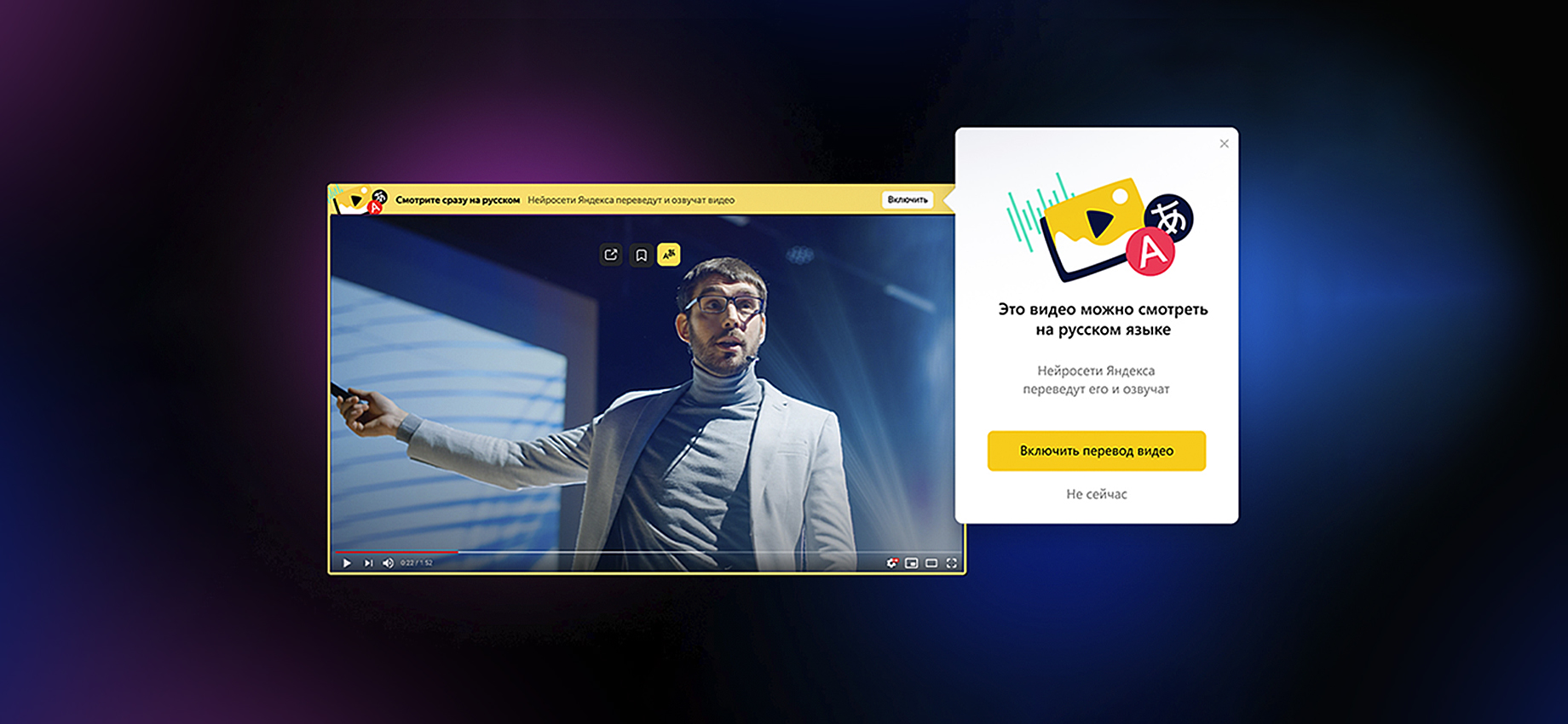

Как включить закадровый перевод видео

В «Яндекс-браузере» на компьютере. Работает сразу же на всех популярных площадках, включая YouTube, Vimeo, TikTok, Twitter, Facebook и «Вконтакте». Заходить на сайты не обязательно — ролики можно переводить прямо в поисковой выдаче. А недавно браузер научился делать закадровую озвучку для курсов на образовательной платформе Coursera.

Для пользователя процесс выглядит очень просто. Достаточно открыть ролик в браузере и навести курсор на видео — сразу появится кнопка с предложением активировать озвучку. Сгенерированный перевод можно включать и выключать на любом отрезке видео.

Технология приглушает оригинальную озвучку и поверх накладывает сгенерированную речь. Мужские голоса озвучиваются мужским голосом, женские — женским. Технология умеет распознавать нескольких спикеров на одном видео, у каждого из них будет свой голос озвучки, чтобы зрители не запутались.

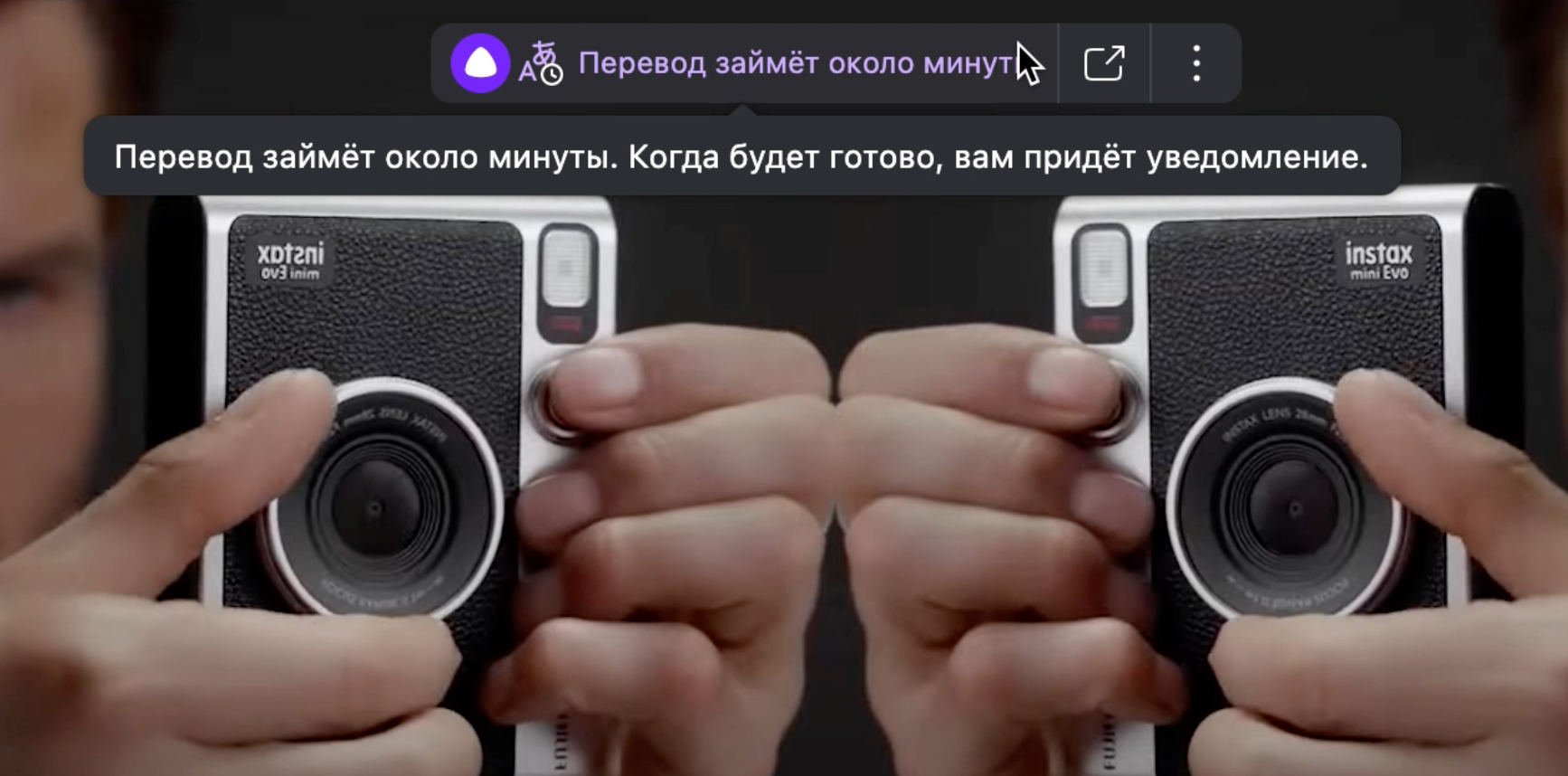

В настройках, которые доступны рядом с иконкой перевода, можно регулировать громкость оригинальной дорожки и включить субтитры. Некоторые видео технология переводит сразу же, потому что другие пользователи переводили их раньше. Для перевода других роликов придется подождать несколько минут. Когда ролик с русской озвучкой будет готов к просмотру, пользователю придет уведомление.

Продолжительность выбранного видео не должна превышать четыре часа. Перевод работает только на платформах, где не требуется лицензирование контента. Например, перевести сериал на «Нетфликсе» не получится.

В приложении «Яндекса» на смартфоне. Здесь все то же самое, что и на компьютере. Встроить закадровый перевод прямо в приложение YouTube нельзя, но ролик можно открыть в браузере «Яндекса».

Иконка с переводом появится сразу под видео, если пропадет — нажмите на ролик.

В других браузерах на компьютере. Официально закадровый перевод «Яндекса» не поддерживается в других браузерах. Но есть неофициальные способы перенести функцию в Google Chrome или Safari.

Мы не приводим ссылки, так как скрипты разработаны третьими лицами — используйте на свой страх и риск.

Как включить перевод прямых трансляций

Перевод прямых трансляций запустили в августе 2022 года. Он работает в тестовом режиме: технология синхронного перевода и озвучки сложнее, чем в случае с готовыми роликами.

Переводить можно только стримы на некоторых ютуб-каналах. Например, запуски SpaceX и NASA, анонсы от Apple и выступления с конференций TED.

Для пользователя перевод прямых трансляций не отличается от перевода видео. Нужно нажать на ту же кнопку во всплывающем окне, и спикеры начнут разговаривать на русском языке.

Как именно нейросети переводят видео

Как именно работает технология и какие проблемы пришлось решать, мне рассказал руководитель перевода видео в «Яндекс-браузере» Сергей Корбан.

Когда началась работа над переводом видео, у браузера уже были нейросети, которые умеют переводить речь в текст и озвучивать текст с помощью синтеза речи. Они используются в других продуктах: например, голосовой помощник «Алиса» слушает человека и распознает его слова, а модуль для распознавания речи конвертирует слова в текст.

Эти технологии и взяли за основу при разработке перевода видео. Но время работы над первой версией технологии команда столкнулась с некоторыми проблемами:

- Нейросети при переводе не очень хорошо улавливали контекст, поэтому их дополнительно обучали на корпусах текстов разных тематик. Первая версия лучше всего переводила экономические, литературные темы и научные статьи. Сейчас технология хорошо справляется с биологией и физикой, но с другими темами периодически возникают сложности, например с игровыми стримами — в них особенная лексика.

- Нейросети умели только определять пол спикера — и то не всегда. В новой версии технология уже может распознавать голоса разных спикеров в одном видео и их пол. Благодаря этому несколько спикеров одного пола озвучиваются разными голосами. Это голоса реальных людей, на которых нейросеть научилась синтезировать озвучку.

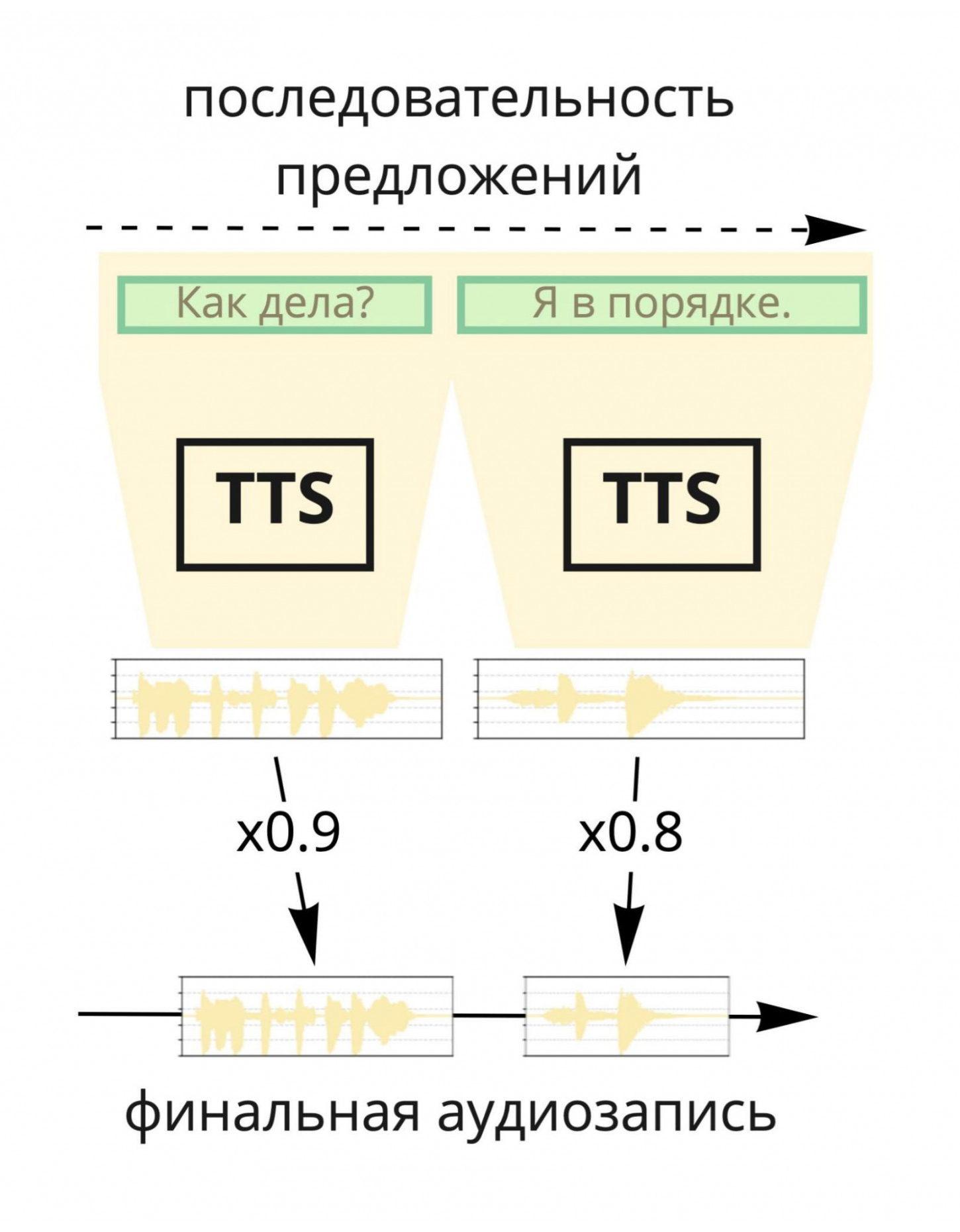

- Перевод нужно было уместить на ту же звуковую дорожку, что и оригинал. При этом длина одной и той же фразы, произнесенной на разных языках, может различаться. Например, в русском языке фразы обычно длиннее, чем в английском. Чтобы озвучка попала в слова, нейросеть, которая отвечает за синтез речи, ускоряет или замедляет речь и делает паузы.

Все эти проблемы решены в текущей версии технологии перевода видео. За это отвечают сразу шесть нейросетей.

Первая нейросеть на стороне переводчика определяет язык спикеров. Если они говорят на языке, который поддерживается, браузер предложит перевести видео.

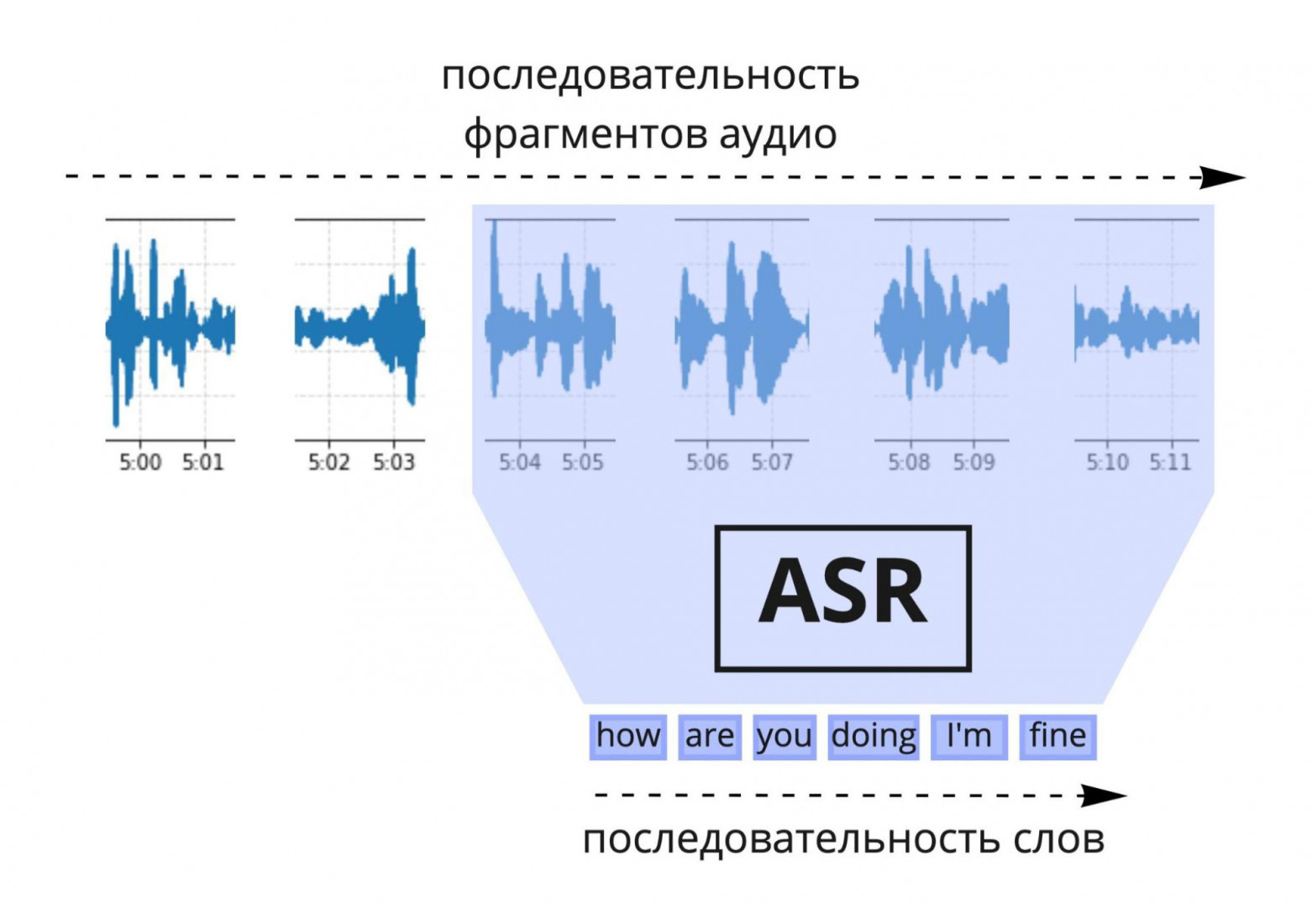

Вторая нейросеть переводит речь спикеров в текст. Модель получает аудиодорожку, из нее она должна вычистить все посторонние звуки. Модель умеет избавляться от слов-паразитов. После всех обработок остается последовательный набор слов — с ним будут работать другие нейросети.

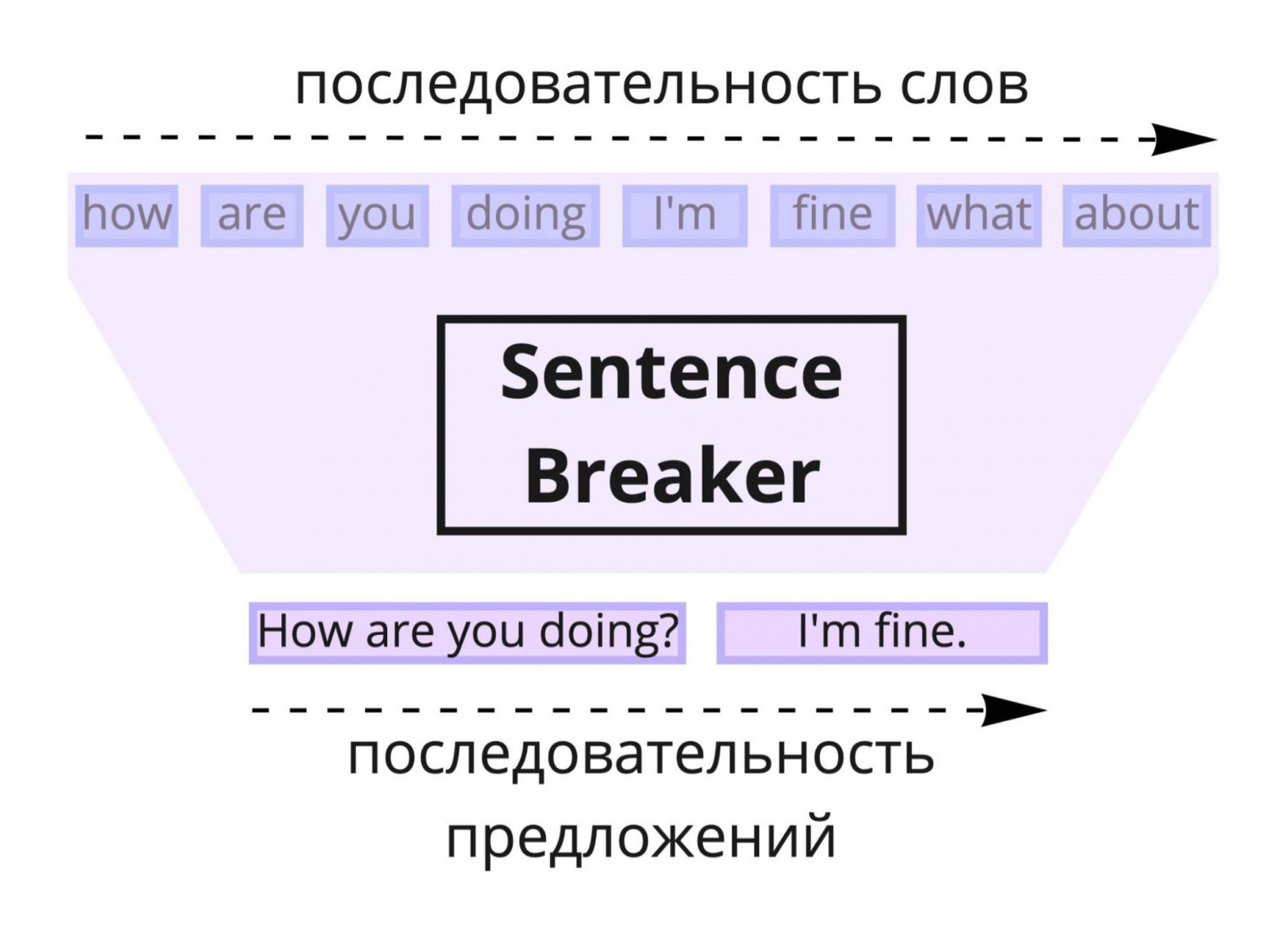

Третья нейросеть нормализует текст и расставляет знаки препинания. Нормализация — это преобразование текста в одну нормальную словарную форму.

Например, расшифровка сокращений. На этом этапе последовательность слов также нарезается в предложения. При их составлении модель должна сохранить изначальный смысл.

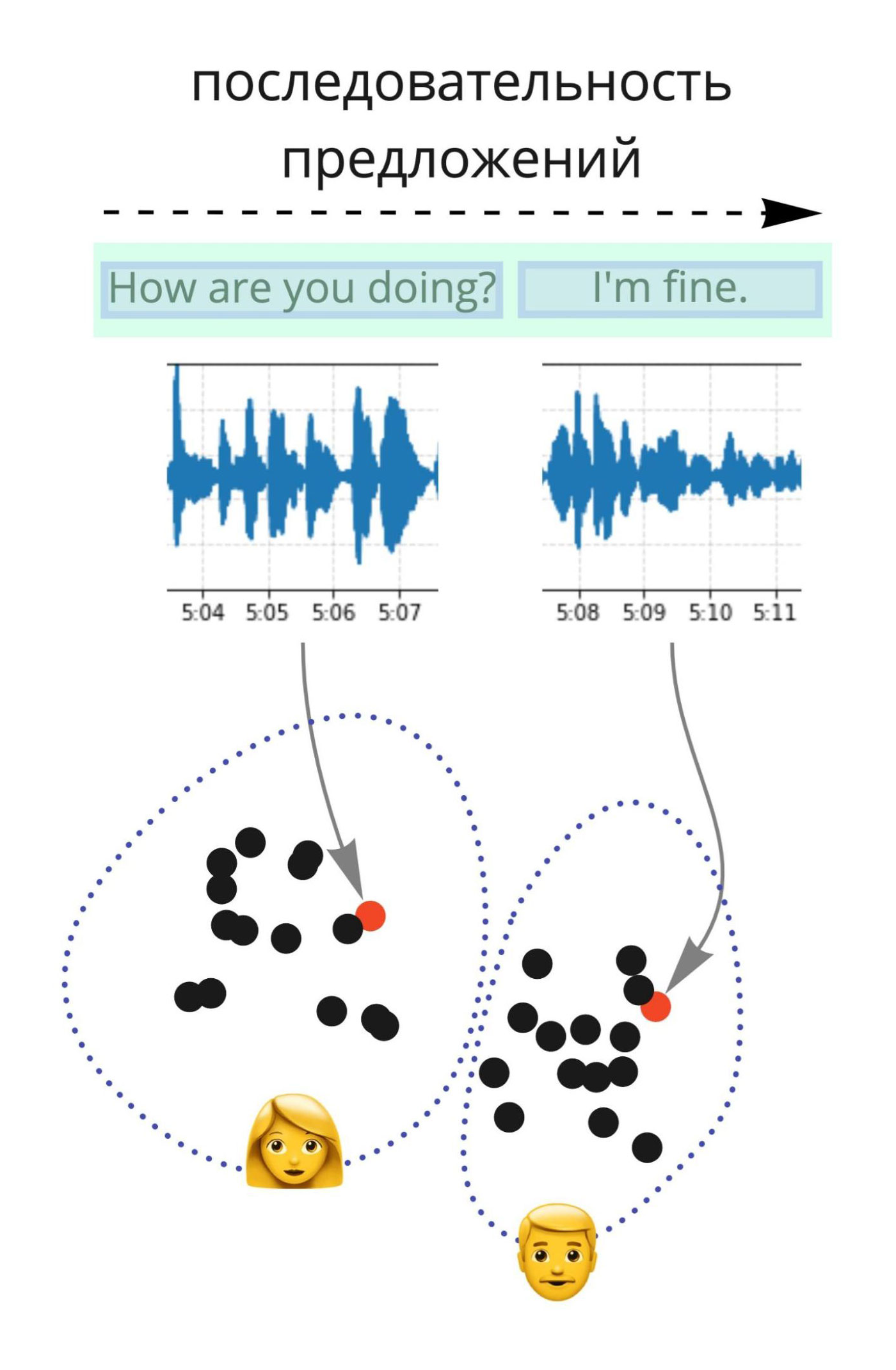

Четвертая нейросеть определяет, сколько спикеров на видео и какой у них голос — мужской или женский. Это нужно, чтобы на другом этапе каждому спикеру присвоить свой голос.

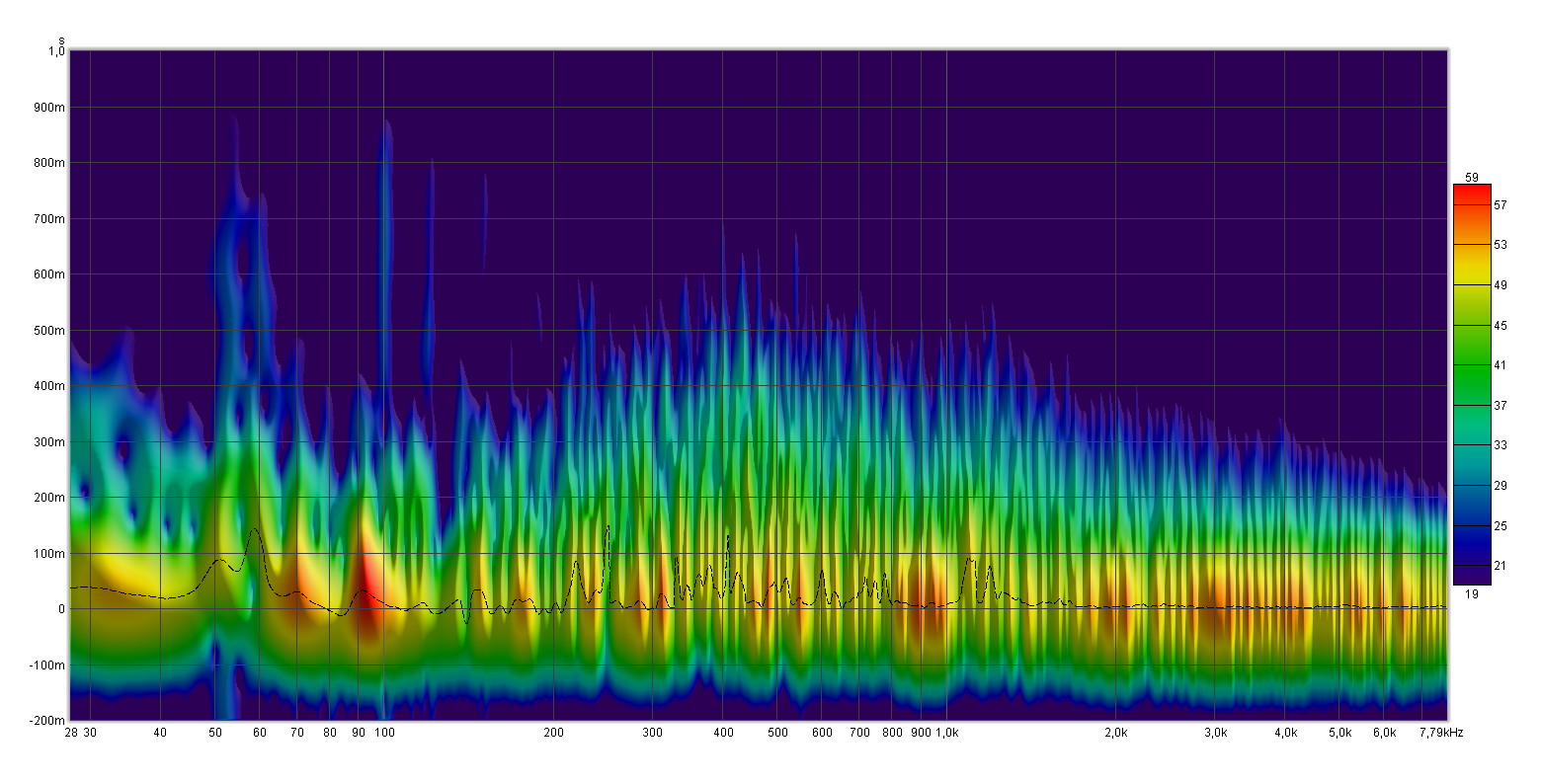

Определить пол можно по частоте голоса: у мужчин это 80—150 Гц, у женщин — 150—250 Гц. Также помогают и местоимения, которые произносит другой спикер.

Пятая нейросеть переводит полученный текст на русский язык. Вместе с текстом модель получает информацию о спикерах, чтобы правильно расставить местоимения.

Шестая нейросеть синтезирует речь. На этом этапе нужно избежать рассинхрона, потому что перевод предложения может оказаться в несколько раз длиннее оригинала. Иногда помогают паузы спикеров, в эти моменты можно уложить перевод. Но иногда приходится ускорять речь.

Как работает перевод прямых трансляций

С точки зрения технологий перевод стрима и перевод записанного видео — две принципиально разные задачи. Перевод потоковых видео построен на другой архитектуре, но работает с теми же моделями.

Переводить потоковые видео сложнее. Нужно одновременно решать две противоречивые задачи — поддерживать качество перевода и не отставать от речи спикеров. При переводе обычных роликов нейросети получают аудиодорожку сразу целиком. У них есть время ее проанализировать, разбить речь на предложения и синтезировать озвучку на русском языке.

Во время работы с прямыми трансляциями такого запаса времени нет — технология работает почти как синхронный переводчик. Чтобы задержка в переводе была небольшой, на помощь приходит нейросеть, которая расставляет в тексте знаки препинания. Это помогает понять, где начинается и заканчивается предложение, найти составные части сложносочиненного предложения, вводные фразы, перечисления и так далее.

После того как знаки препинания расставлены, нейросеть выделяет из текста части, содержащие законченную мысль. Именно они отправляются на перевод, который затем синтезируется и накладывается поверх оригинальной аудиодорожки. Так браузер находит оптимальный баланс между скоростью перевода и его качеством.

Задержка перевода ютуб-трансляций составляет от 30 до 50 секунд. Также в переводе стримов пока используются только два голоса — мужской и женский. Поддержки мультивойса нет.

Что в итоге

- Перевод и закадровая озвучка видео в «Яндекс-браузере» — полезный инструмент для тех, кто плохо знает иностранные языки и не хочет смотреть видео с субтитрами, даже если они есть.

- Нейросеть генерирует закадровую озвучку для роликов на пяти языках и некоторых прямых трансляций на YouTube. Технология не только переводит речь, но и различает спикеров на видео, а также синтезирует разную озвучку для участников видео одного пола.

- Если смотреть на технологию изнутри, то озвучкой в «Яндекс-браузере» занимается не одна нейросеть, а целых шесть. Все они дополняют друг друга.

- Функция работает только в «Яндекс-браузере», но есть способы перенести ее в Chrome или Safari с помощью скрипта.

Мы постим кружочки, красивые карточки и новости о технологиях и поп-культуре в нашем телеграм-канале. Подписывайтесь, там классно: @t_technocult.